بيرت: أكبر تحديث لـ Google منذ سنوات

نشرت: 2022-12-01تم إطلاق برنامج BERT من Google في أواخر عام 2019 وأثر على ما يقرب من 10٪ من جميع عمليات البحث. يمكن القول إنه أحد أكبر تحديثات الخوارزمية لعام 2019 ، إليك كل ما يجب أن يعرفه مُحسّنات محرّكات البحث ومالكي المواقع عن نموذج معالجة اللغة الطبيعية المتقدم من Google.

ما هو Google's BERT؟

BERT هي خوارزمية تعلم عميق ومختصرة لتمثيلات التشفير ثنائي الاتجاه من المحولات. ساعدت الخوارزمية في إظهار المزيد من النتائج ذات الصلة لاستعلامات البحث المعقدة.

ما هو تأثير تحديث خوارزمية BERT على بحث Google؟

هذا ما قالته جوجل:

"تتمحور هذه التحسينات حول تحسين فهم اللغة ، خاصةً بالنسبة إلى المزيد من استعلامات اللغة / المحادثة الطبيعية ، حيث أن BERT قادرة على مساعدة" البحث "في فهم الفروق الدقيقة وسياق الكلمات في عمليات البحث بشكل أفضل ومطابقة هذه الاستعلامات مع نتائج مفيدة بشكل أفضل.

خاصة بالنسبة للاستعلامات الطويلة والمحادثة أو عمليات البحث التي تكون فيها أحرف الجر مثل "for" و "to" مهمة كثيرًا للمعنى ، سيتمكن "البحث" من فهم سياق الكلمات في استعلامك. يمكنك البحث بطريقة تبدو طبيعية بالنسبة لك ".

في الواقع ، وفقًا لـ Google ، سيؤثر تحديث BERT على 1 من كل 10 عمليات بحث باللغة الإنجليزية في الولايات المتحدة ، وهذا يمثل 10٪ من استعلامات البحث. هذا هو أهم تحديث لـ Google في السنوات الخمس الماضية ، على الأقل وفقًا لها:

إننا نحقق تحسينًا كبيرًا في كيفية فهمنا لطلبات البحث ، مما يمثل أكبر قفزة إلى الأمام في السنوات الخمس الماضية ، وإحدى أكبر القفزات إلى الأمام في تاريخ البحث.

تسبب إدخال BERT في تقلبات كبيرة في الترتيب في الأسبوع الأول من نشر الخوارزمية الجديدة. كانت مُحسّنات محرّكات البحث في Webmaster World تعلق على التقلبات منذ بداية الأسبوع ، مشيرة إلى أكبر تذبذب في التصنيف ضرب عالم تحسين محركات البحث (SEO) منذ RankBrain.

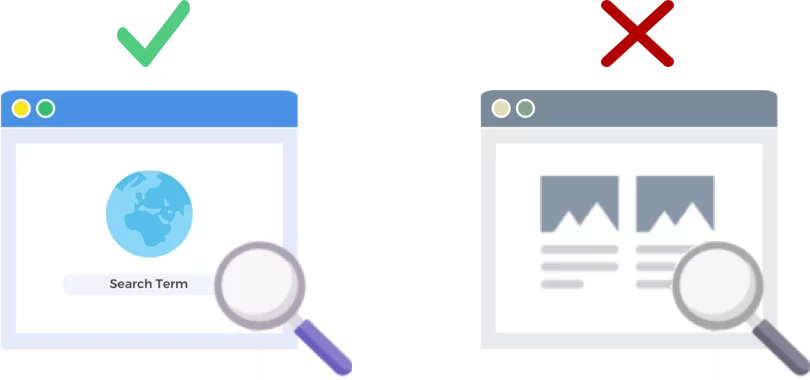

يحلل BERT استعلامات البحث وليس صفحات الويب

يعمل إصدار 24 أكتوبر 2019 من خوارزمية BERT على تحسين كيفية تحليل محرك البحث العملاق وفهم استعلامات البحث (وليس صفحات الويب).

كيف يعمل بيرت؟

يعمل BERT على تحسين فهم Google لاستعلامات البحث باستخدام نموذج سياق ثنائي الاتجاه (وهذا هو B في BERT). تحدثت Google في الواقع قليلاً عن ميكانيكا BERT في هذا الوقت من العام الماضي عندما أعلنت أن BERT هي تقنية جديدة للتدريب المسبق على معالجة اللغة الطبيعية (NLP).

ما هو التدريب المسبق؟ التدريب المسبق هو مجرد تعليم الآلة كيفية القيام بالمهام ، قبل أن تعطيها عملاً لتقوم به. تقليديًا ، يتم تحميل مجموعات بيانات ما قبل التدريب ببضعة آلاف إلى بضع مئات الآلاف من الأمثلة التي تحمل علامات بشرية.

كان التدريب المسبق موجودًا لفترة وجيزة ، ولكن ما يجعل BERT مميزًا هو أنه سياقي (يتغير معنى كل كلمة بناءً على الكلمات المحيطة بها) وثنائي الاتجاه - يُفهم معنى الكلمة بناءً على الكلمات قبلها و بعد ذلك.

لكل مدونة جوجل:

في الجملة " لقد دخلت إلى الحساب المصرفي " ، سيمثل النموذج السياقي أحادي الاتجاه " البنك " استنادًا إلى " لقد دخلت إلى " ولكن ليس " الحساب ". ومع ذلك ، تمثل BERT " البنك " باستخدام كل من السياق السابق والتالي - " لقد دخلت إلى ... الحساب " - بدءًا من أسفل الشبكة العصبية العميقة ، مما يجعلها ثنائية الاتجاه بعمق.

يعتمد تحديث Google BERT على التطورات الحديثة في التعلم الآلي والتعرف على الكيانات. يساعد BERT بشكل أساسي في تحديد جميع أجزاء الكلام وسياق الكلمات قبل معالجة Google للبحث.

ماذا يعني BERT لنتائج البحث؟

وفقًا لـ Google ، فهذا يعني أن المستخدمين سيبدأون في رؤية المزيد من النتائج ذات الصلة ، والنتائج التي تتطابق بشكل أفضل مع هدف بحث المستخدم. سيشمل تحسين الخوارزمية هذا النتائج المنتظمة ونتائج المقتطف المنسق.

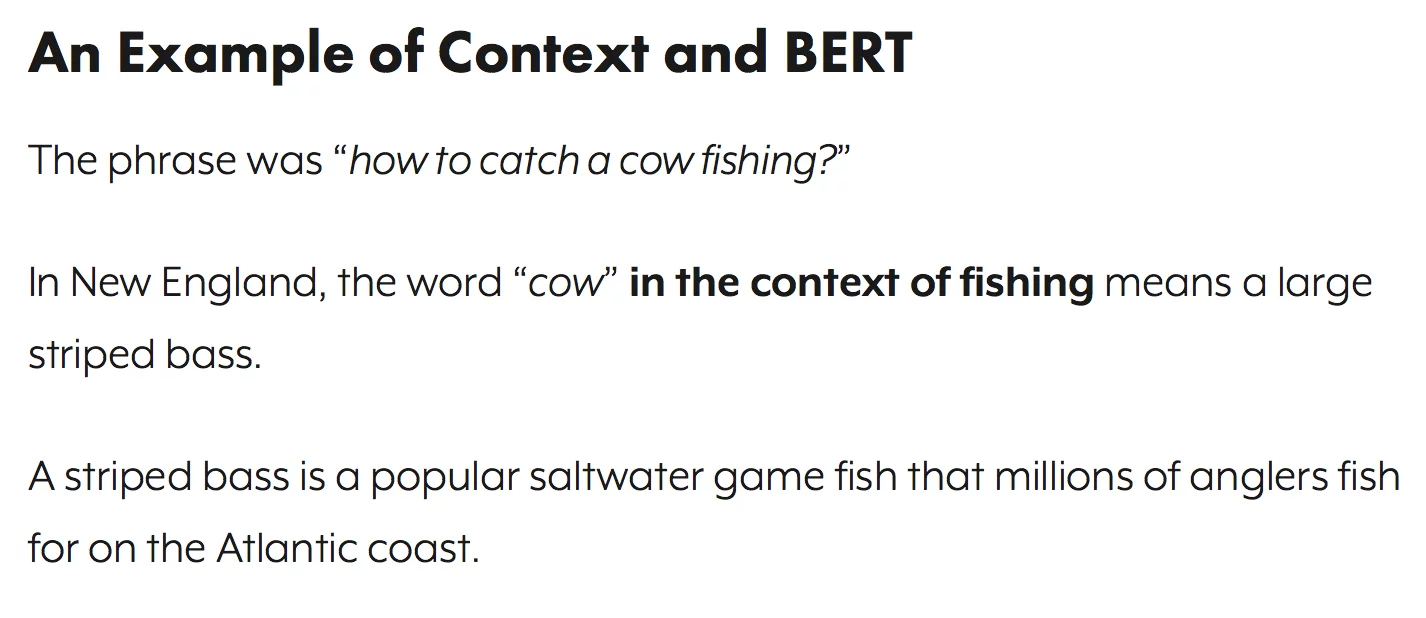

قدمت Google بعض الأمثلة المفيدة في إدخال المدونة الخاص بهم للإعلان عن BERT.

مثال خبير التجميل

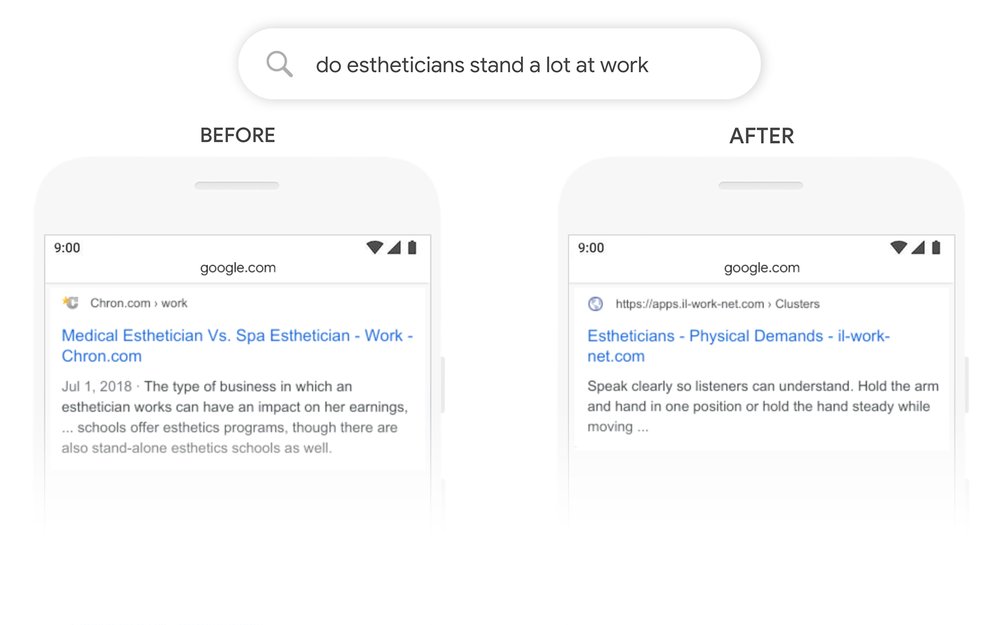

أولاً ، لدينا مستخدم يحاول فهم ما إذا كان خبراء التجميل يقضون الكثير من الوقت على أقدامهم كجزء من الوظيفة.

يمكنك أن ترى أدناه أنه قبل قراءة BERT Google للاستعلام "هل يقف خبراء التجميل كثيرًا في العمل" وأنتجوا نتيجة تقارن بين أنواع بيئات العمل لخبراء التجميل.

بعد أن قام BERT Google بطرح مقالة حول المتطلبات المادية لكونك خبير تجميل ، كان الأمر أكثر انسجامًا مع المعلومات التي كان الباحث يحاول طرحها في الأصل.

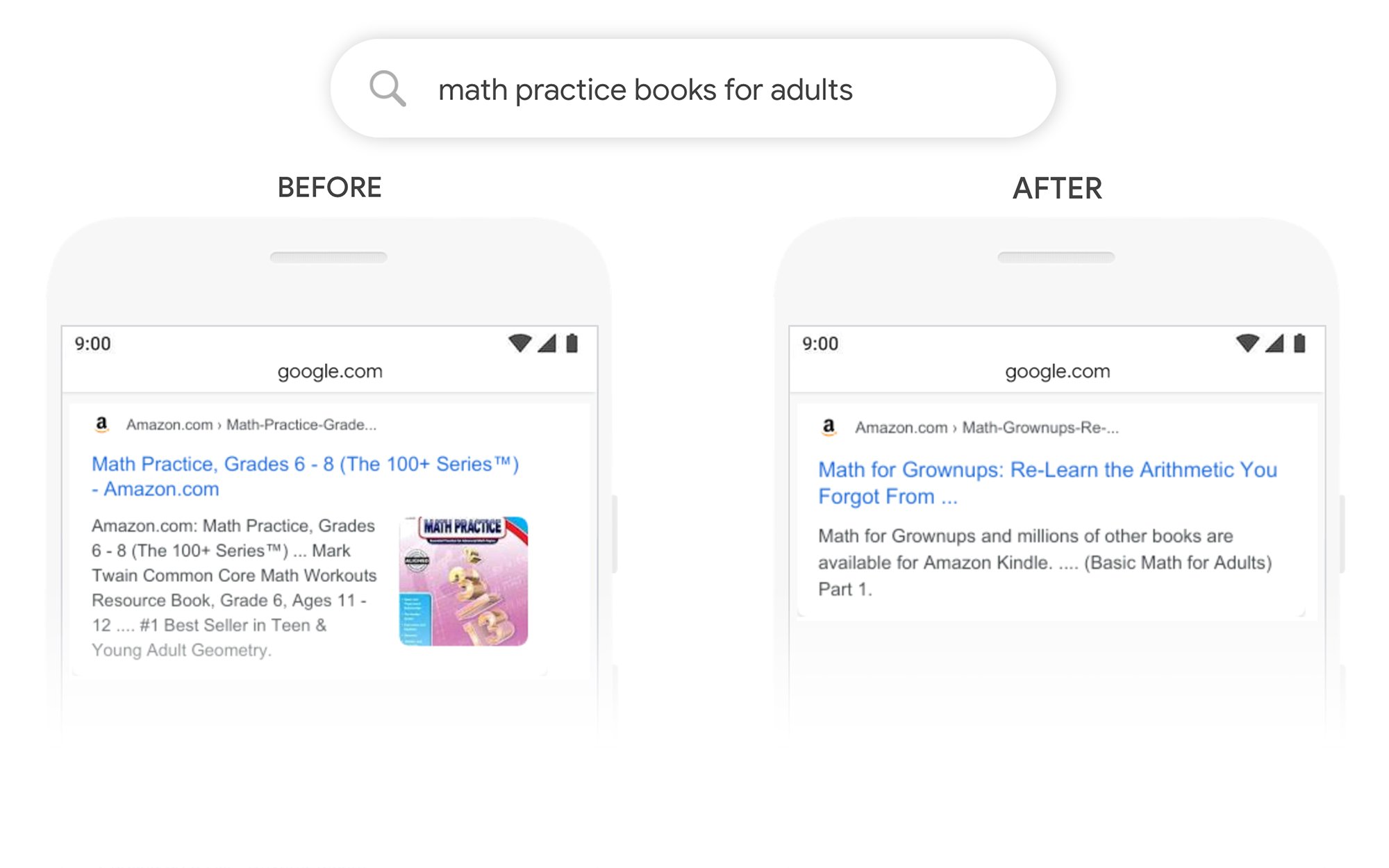

مثال كتب ممارسة الرياضيات

في هذا المثال ، يبحث المستخدم عن كتب تمارين الرياضيات للكبار ، لكنه يُظهر كتبًا لممارسة الرياضيات للأطفال.

بعد BERT ، يتعرف Google بشكل صحيح على سياق الاستعلام ، وهو ما يمثل أفضل بالنسبة للجزء الثاني من البحث "للبالغين".

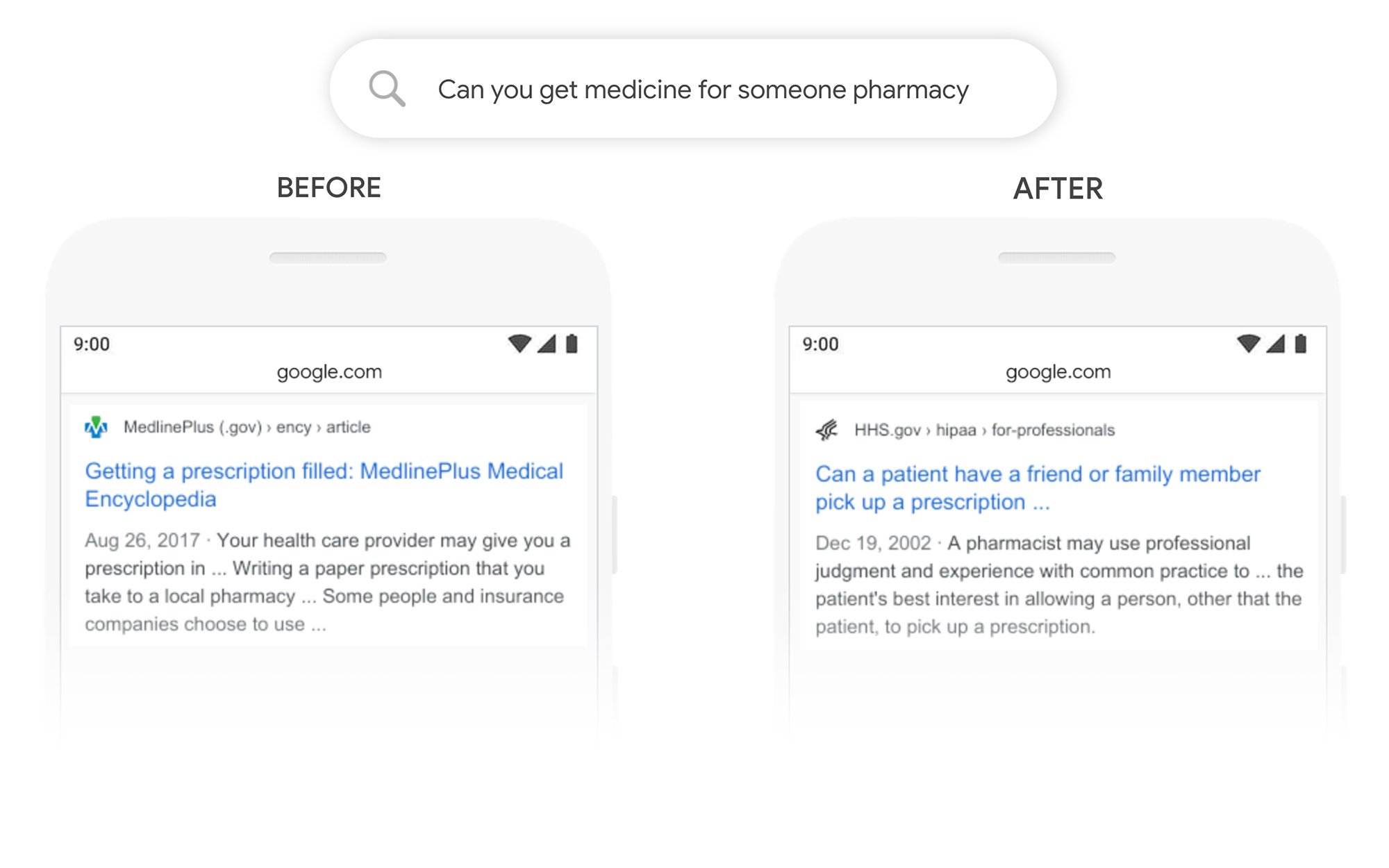

هل يمكنك التقاط دواء لشخص آخر على سبيل المثال

في هذا المثال ، يعرض الاستعلام "هل يمكنك الحصول على دواء لصيدلية شخص ما" نتيجة حول كيفية ملء الوصفات الطبية بشكل عام ، بدلاً من كيفية ملئها لطرف ثالث. بعد BERT ، تتفهم Google بشكل أفضل هدف المستخدم وتكشف عن قطعة حول ما إذا كان يمكن للمريض أن يحصل على صديق أو أحد أفراد الأسرة من أجل الحصول على الوصفة الطبية الخاصة به أم لا.

ما الذي يمكنني فعله لتحسين الترتيب بعد BERT؟

بالنسبة لأية كلمات رئيسية تفقد فيها التصنيفات ، يجب عليك إلقاء نظرة على صفحة نتائج البحث المنقحة لفهم كيفية عرض Google لهدف البحث الخاص بالمصطلحات المستهدفة بشكل أفضل. ثم قم بمراجعة المحتوى الخاص بك وفقًا لذلك لتحقيق أهداف المستخدم بشكل أفضل.

إذا فقدت التصنيفات بموجب BERT ، فمن المرجح أن تكون مشكلة تتعلق بمدى مطابقة صفحتك لنية بحث المستخدم (تساعد المستخدم في الوصول إلى هدفه) أكثر من كونها مشكلة تتعلق بجودة المحتوى.

نظرًا لأنه من المحتمل أن يدعم BERT جهود البحث الصوتي بمرور الوقت ، فإننا نوصي أيضًا بأن تكتب مواقع الويب نسخة واضحة وموجزة. لا تستخدم لغة الحشو ، ولا تكن غامضًا ، وتناول الموضوع مباشرة.

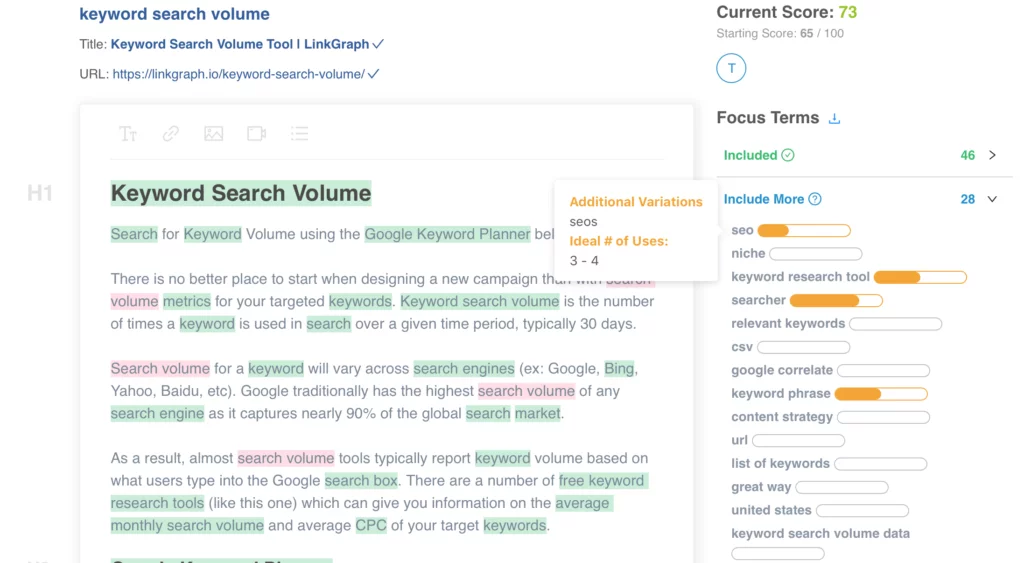

هل تحتاج إلى مساعدة في تحسين المحتوى الخاص بك؟ تحقق من مُحسِّن محتوى الصفحة من LinkGraph ، أو تواصل مع أحد أعضاء فريقنا على [email protected] ، أو حدد موعدًا لاجتماع للحصول على الإعداد اليوم.

أين يمكنني معرفة المزيد؟

قدمت Dawn Anderson عرضًا تقديميًا رائعًا في وقت سابق من هذا الشهر في Pubcon حول "سباق المتصدرين لفهم Google BERT والأسرة واللغة الطبيعية" ، ويمكنك إلقاء نظرة على عرضها التقديمي.

شكرا لاستضافتي #Pubcon. هنا هو مجموعتي <3 <3 https://t.co/aGYDI9pfdY

- Dawn Anderson (dawnieando) 10 أكتوبر 2019

قام Jeff Dean مؤخرًا بإلقاء كلمة رئيسية على AI في Google بما في ذلك BERT ، والتي يمكنك مشاهدتها.