Risque élevé, récompense élevée : comment les marques peuvent utiliser l'IA de manière éthique

Publié: 2023-07-18L'IA générative a déjà changé le monde, mais tout ce qui brille n'est pas or. Alors que l'intérêt des consommateurs pour ChatGPT est élevé, les experts et les consommateurs s'inquiètent de plus en plus des dangers de l'IA pour la société. Les inquiétudes concernant la perte d'emploi, la sécurité des données, la désinformation et la discrimination sont quelques-uns des principaux domaines alarmants.

L'IA est la peur qui connaît la croissance la plus rapide aux États-Unis, en hausse de 26 % par rapport à il y a seulement un quart.

L'IA changera sans aucun doute notre façon de travailler, mais les entreprises doivent être conscientes des problèmes qui l'accompagnent. Dans ce blog, nous explorerons les inquiétudes des consommateurs concernant la sécurité de l'emploi et des données, comment les marques peuvent atténuer les inquiétudes et se protéger elles-mêmes et les consommateurs contre les risques potentiels.

1. Sauvegarder l'IA générative

Le contenu d'IA génératif, comme ChatGPT et le créateur d'images DALL-E, fait rapidement partie de la vie quotidienne, avec plus de la moitié des consommateurs voyant du contenu généré par l'IA au moins une fois par semaine. Comme ces outils nécessitent d'énormes quantités de données pour apprendre et générer des réponses, des informations sensibles peuvent se faufiler dans le mélange.

Avec de nombreuses pièces mobiles, les plates-formes d'IA génératives permettent aux utilisateurs de contribuer au code de différentes manières dans l'espoir d'améliorer les processus et les performances. L'inconvénient est qu'avec de nombreuses contributions, les vulnérabilités passent souvent inaperçues et des informations personnelles peuvent être exposées. Cette situation exacte est ce qui est arrivé à ChatGPT début mai 2023.

Avec plus de la moitié des consommateurs affirmant que les violations de données les amèneraient à boycotter une marque, la confidentialité des données doit être une priorité. Alors que des mesures sont prises pour rédiger des lois sur l'IA, en attendant, les marques doivent s'imposer des règles de transparence et des directives d'utilisation, et les faire connaître au public.

2 consommateurs sur 3 veulent que les entreprises qui créent des outils d'IA soient transparentes sur la façon dont ils sont développés.

Cela peut renforcer la confiance dans la marque, une devise particulièrement convoitée en ce moment. Outre la qualité, la sécurité des données est le facteur le plus important lorsqu'il s'agit de faire confiance aux marques. La fidélité à la marque étant de plus en plus fragile, les marques doivent rassurer les consommateurs sur le fait que leurs données sont entre de bonnes mains.

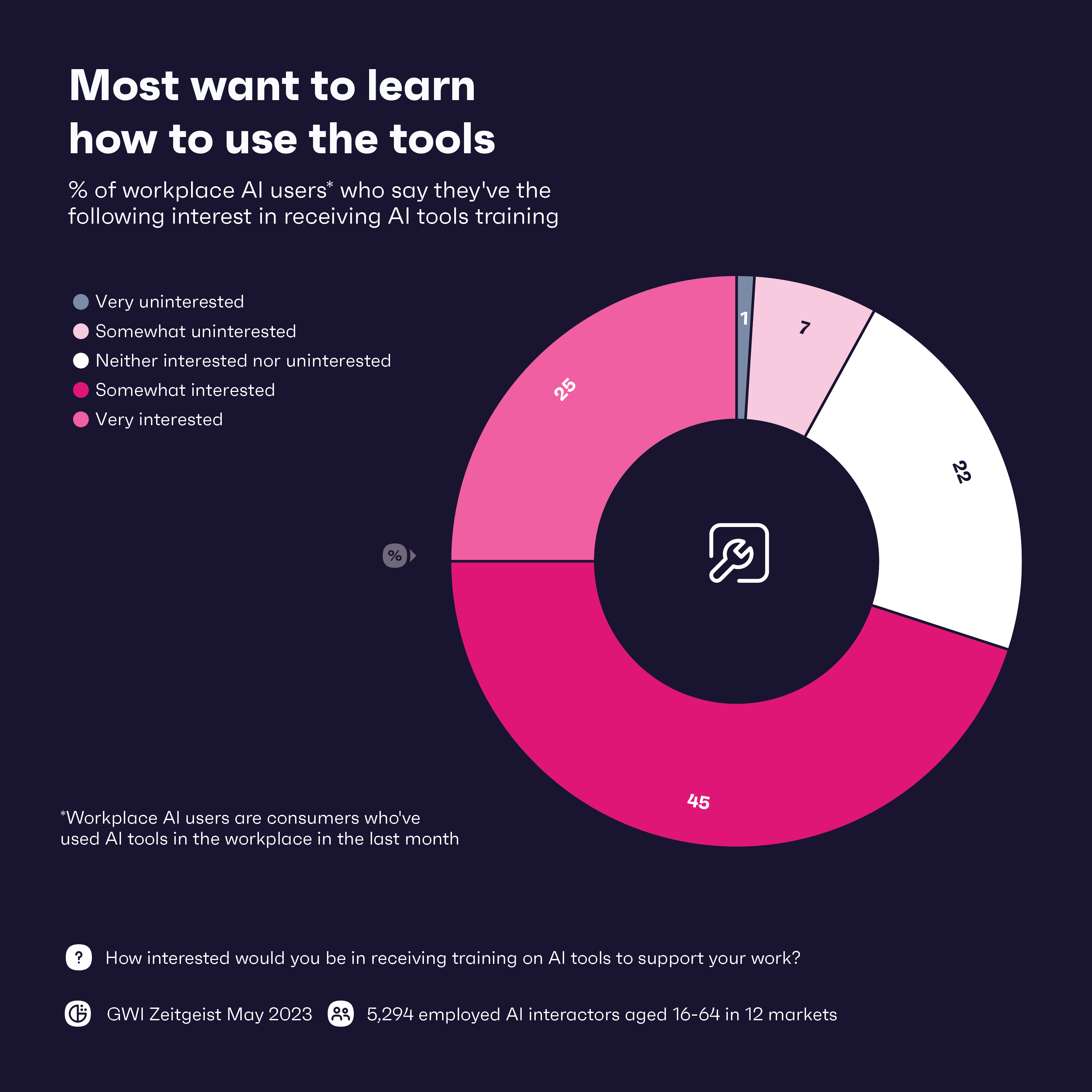

Alors, quelle est l'une des meilleures façons de sécuriser les données à l'ère de l'IA ? La première ligne de défense consiste à former le personnel aux outils d'IA, 71 % des travailleurs déclarant qu'ils seraient intéressés par une formation. Combiner cela avec une formation à la protection des données est tout aussi important. L'éducation est vraiment essentielle ici - armer les travailleurs des connaissances nécessaires pour garantir que la confidentialité des données est à l'esprit ira un long chemin.

2. Rester réel dans un monde de fausses nouvelles

Facebook a mis 4,5 ans pour atteindre 100 millions d'utilisateurs. En comparaison, ChatGPT a mis un peu plus de deux mois pour atteindre ce jalon.

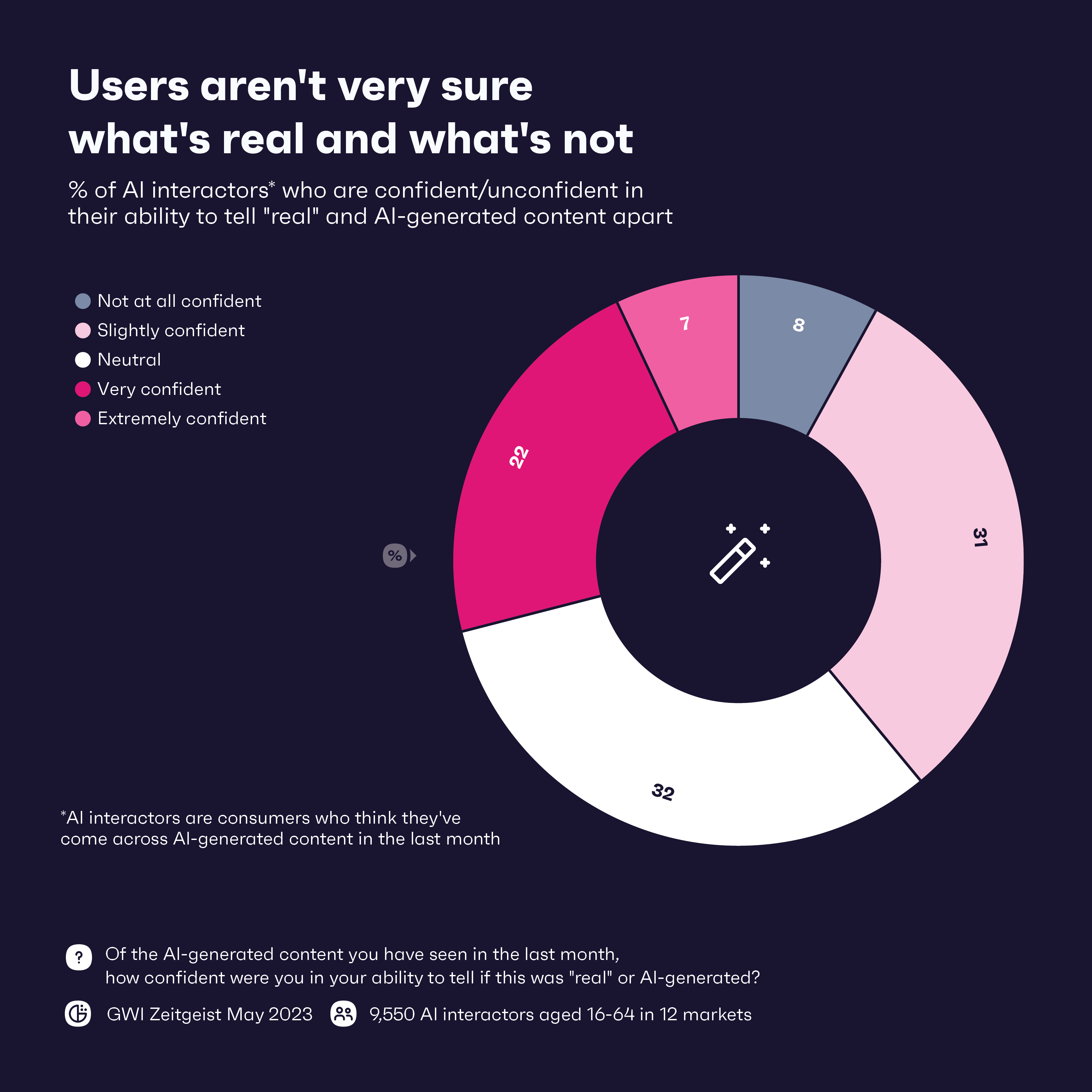

Aussi impressionnante que soit la montée en puissance de l'IA générative, elle a été un aimant pour la création de fausses nouvelles sous la forme d'audios et de vidéos, connus sous le nom de deepfakes. La technologie a déjà été utilisée pour diffuser de la désinformation dans le monde entier. Seuls 29 % des consommateurs sont confiants dans leur capacité à distinguer le contenu généré par l'IA du "vrai" contenu, ce qui empirera probablement à mesure que les deepfakes deviendront plus sophistiqués.

Près des deux tiers des utilisateurs de ChatGPT déclarent interagir avec l'outil comme ils le feraient avec une vraie personne, ce qui montre à quel point l'outil pourrait être potentiellement persuasif.

Mais les consommateurs ont vu cela venir ; 64 % disent craindre que les outils d'IA puissent être utilisés à des fins contraires à l'éthique. Avec cette préoccupation et une faible confiance dans la détection des deepfakes, ce sont les marques qui peuvent faire la différence en protégeant les consommateurs de cette dernière vague de fausses nouvelles et en fournissant une éducation sur la façon d'identifier ce contenu.

Les marques peuvent commencer par mettre en œuvre la vérification des sources et mener une diligence raisonnable sur toute information qu'elles souhaitent partager ou promouvoir. Dans le même ordre d'idées, ils peuvent s'associer ou utiliser des processus internes de vérification des faits sur tous les reportages qu'ils pourraient recevoir. Pour la plupart des marques, ces mesures seront probablement déjà en place, car les fausses nouvelles et la désinformation sévissent depuis des années.

Mais à mesure que les deepfakes deviennent plus intelligents, les marques devront rester au top. Pour les battre, les marques devront peut-être se tourner à nouveau vers l'IA sous la forme d'outils de détection basés sur l'IA capables d'identifier et de signaler le contenu généré par l'IA. Ces outils deviendront une nécessité à l'ère de l'IA, mais cela ne suffira peut-être pas car les mauvais acteurs ont généralement une longueur d'avance. Mais, une combinaison d'outils de détection et de surveillance humaine pour interpréter correctement le contexte et la crédibilité pourrait contrecarrer le pire.

La transparence est également essentielle. Faire savoir aux consommateurs que vous faites quelque chose pour lutter contre les fausses nouvelles générées par l'IA peut marquer des points de confiance avec eux et aider à établir des normes de l'industrie qui peuvent aider tout le monde à rester en phase contre les deepfakes.

3. Combattre les préjugés inhérents

Personne ne veut d'un cauchemar de relations publiques, mais c'est une possibilité réelle si les marques ne vérifient pas deux fois trois fois les informations qu'elles obtiennent de leurs outils d'IA. N'oubliez pas que les outils d'IA apprennent à partir de données extraites d'Internet - des données pleines de préjugés humains, d'erreurs et de discrimination.

Pour éviter cela, les marques doivent utiliser des ensembles de données diversifiés et représentatifs pour former des modèles d'IA. Bien qu'il soit presque impossible d'éliminer complètement les biais et la discrimination, l'utilisation d'un large éventail d'ensembles de données peut aider à en éliminer certains. De plus en plus de consommateurs sont préoccupés par la façon dont les outils d'IA sont développés, et une certaine transparence sur le sujet pourrait leur faire un peu plus confiance à ces outils.

Alors que toutes les marques devraient se soucier d'utiliser des données impartiales, certaines industries doivent être plus prudentes que d'autres. Les marques bancaires et de soins de santé en particulier doivent être extrêmement conscientes de la façon dont elles utilisent l'IA, car ces industries ont des antécédents de discrimination systémique. Selon nos données, un comportement qui cause du tort à des communautés spécifiques est la principale raison pour laquelle les consommateurs boycotteraient une marque, et dans les téraoctets de données utilisées pour former des outils d'IA se trouvent des données potentiellement nuisibles.

En plus d'un examen détaillé des ensembles de données utilisés, les marques ont également besoin d'humains, de préférence formés à la diversité, à l'équité et à l'inclusion (DE&I), pour superviser l'ensemble du processus. Selon notre ensemble de données GWI USA Plus, DE&I est important pour 70 % des Américains, et ils sont plus susceptibles d'acheter auprès de marques qui partagent leurs valeurs.

4. Trouver le bon équilibre avec l'automatisation sur le lieu de travail

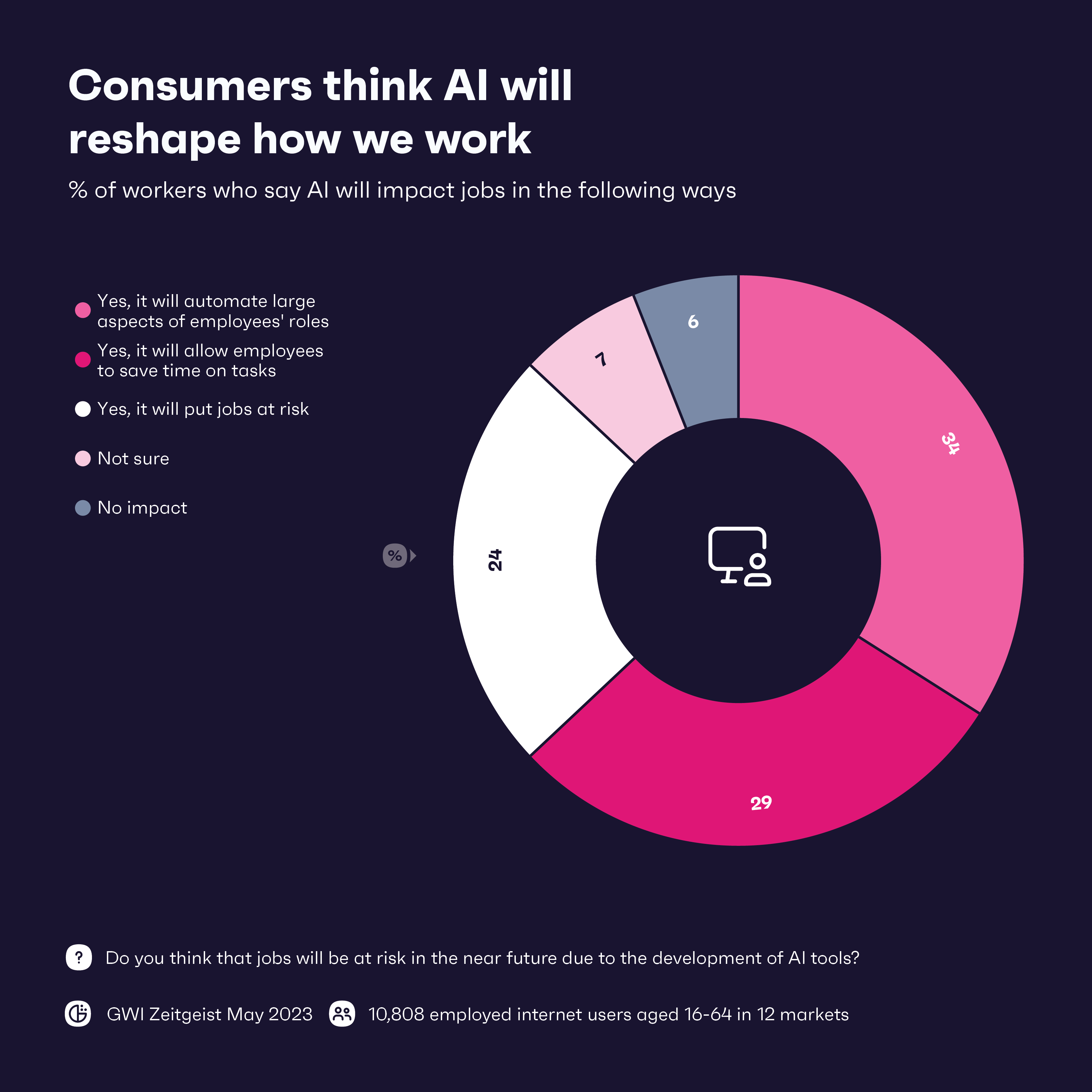

Abordons l'éléphant dans la pièce. L'IA sera-t-elle l'amie ou l'ennemie des travailleurs ? Il ne fait aucun doute que cela changera le travail tel que nous le connaissons, mais l'ampleur de l'impact de l'IA sur le lieu de travail dépend de la personne à qui vous demandez.

Ce que nous savons , c'est qu'une grande majorité de travailleurs s'attendent à ce que l'IA ait une sorte d'impact sur leur travail. L'automatisation de grands aspects des rôles des employés est attendue, en particulier dans les secteurs de la technologie et de la fabrication/logistique. Dans l'ensemble, les travailleurs semblent enthousiasmés par l'IA, 8 secteurs sur 12 affirmant que l'automatisation aura un impact positif.

D'un autre côté, près de 25 % des travailleurs considèrent l'IA comme une menace pour l'emploi, et ceux qui travaillent dans les secteurs du voyage, de la santé et de la beauté sont particulièrement nerveux. L'IA générative semble s'améliorer de façon exponentielle chaque mois. La question est donc la suivante : si l'IA peut désormais s'occuper de tâches banales, que se passera-t-il ensuite ?

Même si l'IA occupe quelque 80 millions d'emplois dans le monde, les travailleurs peuvent trouver des moyens d'utiliser efficacement l'IA pour améliorer leurs propres compétences, même dans les secteurs vulnérables. Le service client est sur le point de subir des mises à niveau majeures avec l'IA, mais cela ne peut se faire sans les humains. L'IA générative peut traiter la plupart des demandes, mais les humains doivent être là pour traiter les informations sensibles et apporter une touche d'empathie. Les humains peuvent également travailler avec l'IA pour fournir des solutions et des recommandations plus personnalisées, ce qui est particulièrement important dans les industries du voyage et de la beauté.

L'IA automatisant certaines tâches peut libérer les travailleurs pour qu'ils contribuent d'autres manières. Ils peuvent consacrer plus de temps à la réflexion stratégique et à la recherche de solutions innovantes, pouvant déboucher sur de nouveaux produits et services. Ce sera différent pour chaque entreprise et chaque industrie, mais ceux qui sont capables de trouver le bon équilibre entre l'IA et les travailleurs humains devraient prospérer à l'ère de l'IA.

La dernière invite : ce que vous devez savoir

L'IA peut être puissante, mais les marques doivent être conscientes des risques. Ils devront protéger les données des consommateurs et être au courant des fausses nouvelles. La transparence sera la clé. Les consommateurs sont nerveux quant à l'avenir de l'IA, et les marques leur montrant qu'ils se comportent de manière éthique et responsable iront loin.

La technologie est passionnante et aura probablement un impact positif sur le lieu de travail dans son ensemble. Mais les marques doivent procéder avec prudence et essayer de trouver le juste équilibre entre la technologie et le capital humain. Les employés auront besoin d'une formation approfondie sur l'éthique, la sécurité et la bonne application, ce qui améliorera leurs compétences. En intégrant des outils d'IA pour travailler aux côtés des personnes, au lieu de les remplacer purement et simplement, les marques peuvent trouver un équilibre qui les préparera à un avenir amélioré par l'IA.