ハイリスク、ハイリターン: ブランドが AI を倫理的に使用するにはどうすればよいか

公開: 2023-07-18生成 AI はすでに世界を変えていますが、輝くものすべてが金というわけではありません。 ChatGPT などに対する消費者の関心は高い一方で、社会に対する AI の危険性について専門家と消費者の両方の間で懸念が高まっています。 失業、データセキュリティ、誤った情報、差別に関する懸念は、警戒を引き起こす主な分野の一部です。

AIは米国で最も急速に高まっている恐怖であり、わずか四半期前と比べて26%増加した。

AI が私たちの働き方を変えることは間違いありませんが、企業は AI に伴う問題を認識する必要があります。 このブログでは、仕事とデータのセキュリティに関する消費者の懸念と、ブランドが懸念を軽減し、ブランド自身と消費者の両方を潜在的なリスクから守る方法について探っていきます。

1. 生成型 AI の保護

ChatGPT やイメージ クリエーター DALL-E などの生成 AI コンテンツは急速に日常生活の一部になりつつあり、消費者の半数以上が AI 生成コンテンツを少なくとも毎週見ています。 これらのツールは学習して応答を生成するために大量のデータを必要とするため、機密情報が混入する可能性があります。

多くの可動部分がある生成 AI プラットフォームでは、ユーザーはプロセスとパフォーマンスの向上を期待して、さまざまな方法でコードを貢献できます。 欠点は、多数の貢献があるため、脆弱性が気づかれないことが多く、個人情報が漏洩する可能性があることです。 これはまさに、2023 年 5 月初旬に ChatGPT に起こった状況です。

消費者の半数以上が、データ侵害がブランドをボイコットする原因になると回答しているため、データプライバシーを優先する必要があります。 AI に関する法律を制定するための措置が講じられていますが、それまでの間、ブランドは透明性ルールと使用ガイドラインを自主的に課し、それらを一般に周知する必要があります。

消費者の 3 人に 2 人は、AI ツールを作成する企業がその開発方法について透明であることを望んでいます。

そうすることで、現在特に切望されている通貨であるブランドの信頼を築くことができます。 ブランドを信頼する上で、品質とは別に、データ セキュリティが最も重要な要素です。 ブランドロイヤルティがますます脆弱になる中、ブランドはデータが安全に保管されていることを消費者に安心させる必要があります。

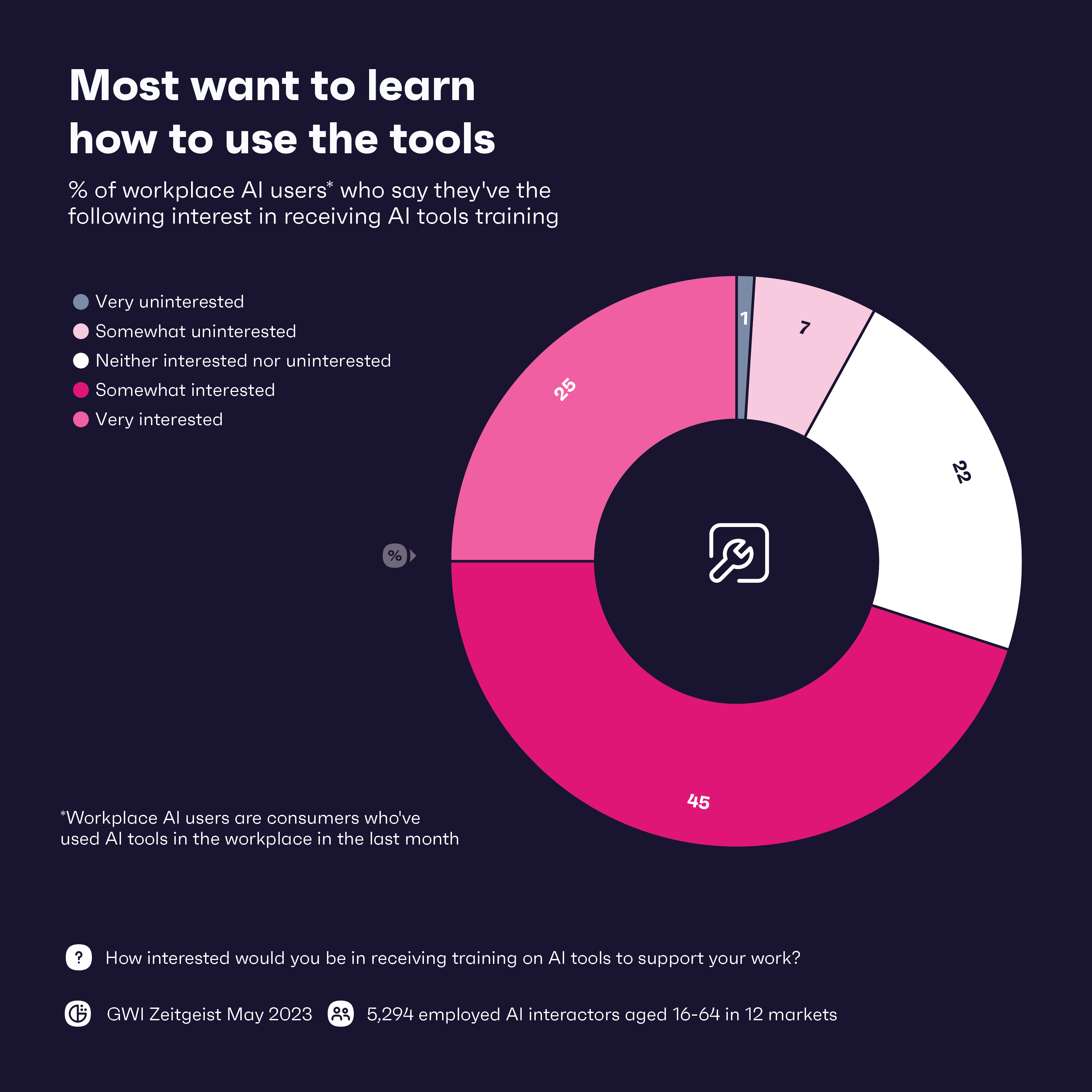

では、AI 時代にデータを保護する最善の方法の 1 つは何でしょうか? 防御の第一線は AI ツールに関するスタッフのトレーニングであり、従業員の 71% がトレーニングに興味があると回答しています。 これをデータ保護トレーニングと組み合わせるのも同様に重要です。 ここでは教育が非常に重要です。データのプライバシーを最優先にするために必要な知識を従業員に提供することは、大きな効果があります。

2. フェイクニュースの世界で真実を保つ

Facebook はユーザー数 1 億人を達成するのに 4 年半かかりました。 比較すると、ChatGPT はそのマイルストーンに到達するまでに 2 か月強しかかかりませんでした。

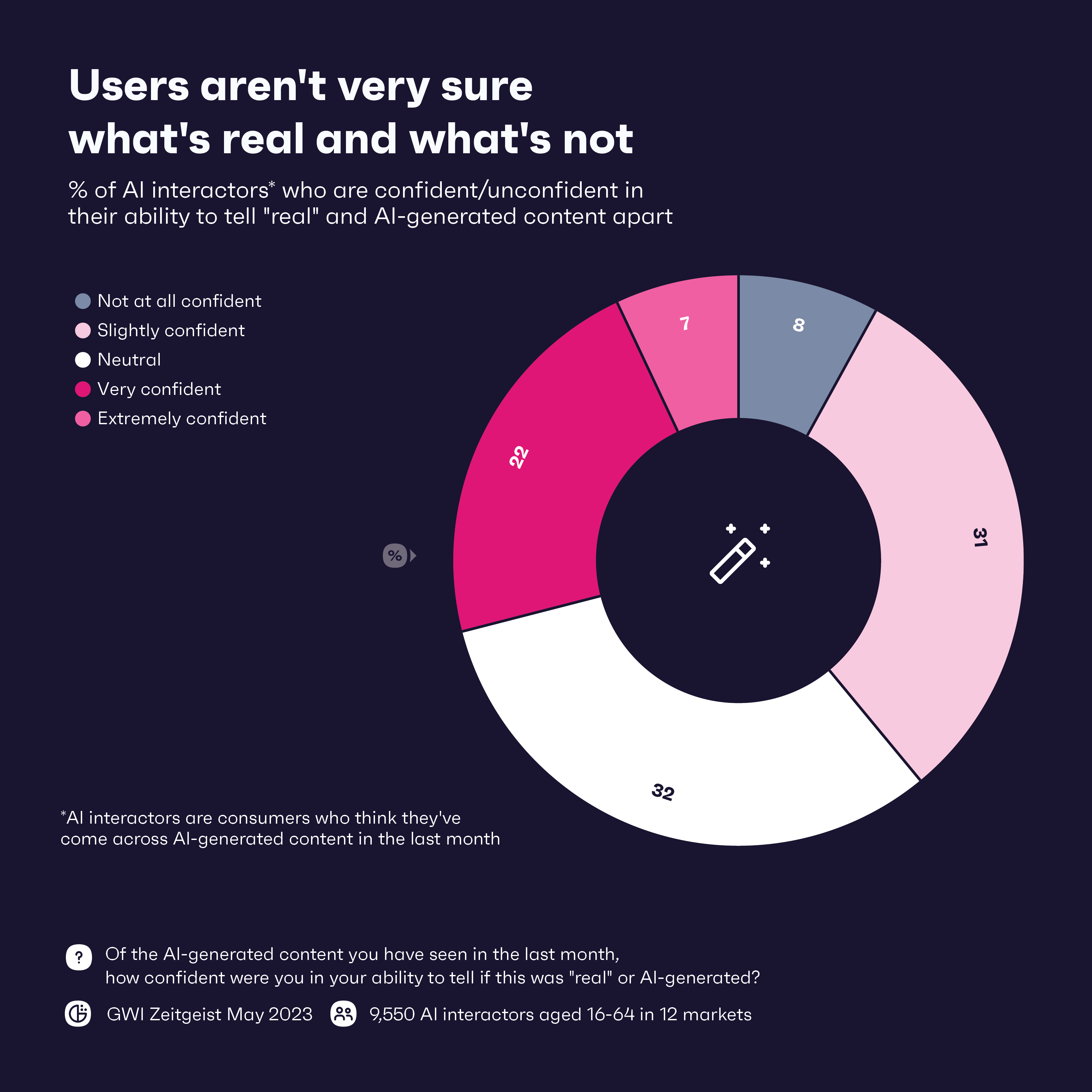

生成 AI の台頭は目覚ましいものですが、ディープフェイクとして知られる音声やビデオの形式でのフェイク ニュース作成を引き寄せています。 この技術はすでに世界中で誤った情報を拡散するために使用されています。 AI が生成したコンテンツと「本物の」コンテンツを区別する能力に自信を持っている消費者はわずか 29% であり、ディープフェイクがより洗練されるにつれて、この状況はさらに悪化する可能性があります。

ChatGPT ユーザーの 3 分の 2 近くが、実際の人間と同じようにこのツールを操作していると回答しており、このツールがいかに説得力を持つ可能性があるかを示しています。

しかし、消費者はこれが来ることを予見していました。 64% が、AI ツールが非倫理的な目的に使用される可能性があることを懸念していると回答しています。 このような懸念があり、ディープフェイクの検出に対する信頼性が低い中、この最新のフェイクニュースの波から消費者を守り、そのようなコンテンツを識別する方法に関する教育を提供する上で変化をもたらすことができるのはブランドです。

ブランドは、情報源の検証を実施し、共有または宣伝したい情報についてのデューデリジェンスを実施することから始めることができます。 同様に、受信したニュース記事について提携したり、社内の事実確認プロセスを使用したりすることもできます。 フェイクニュースや誤った情報は何年も横行しているため、ほとんどのブランドではこうした対策がすでに導入されている可能性が高い。

しかし、ディープフェイクがより賢くなるにつれて、ブランドはディープフェイクを常に把握し続ける必要があります。 これらに打ち勝つために、ブランドは、AI が生成したコンテンツを識別してフラグを立てることができる AI ベースの検出ツールの形で、AI をもう一度活用する必要があるかもしれません。 これらのツールは AI の時代には必需品になりますが、通常は悪意のある者が一歩先を行っているため、それだけでは十分ではない可能性があります。 しかし、コンテキストと信頼性を正しく解釈するための検出ツールと人間の監視を組み合わせれば、最悪の事態を阻止できる可能性があります。

透明性も重要です。 AI が生成したフェイクニュースに対処するために何かを行っていることを消費者に知らせることで、消費者からの信頼ポイントを獲得でき、ディープフェイクに対して誰もが足並みをそろえることができる業界標準の設定に役立ちます。

3. 固有の偏見と闘う

PR の悪夢を望んでいる人はいませんが、ブランドが AI ツールから得た情報を二重三重にチェックしていなければ、その可能性は現実にあります。 AI ツールはインターネットから収集したデータ、つまり人間の偏見、間違い、差別に満ちたデータから学習することを忘れないでください。

これを避けるために、ブランドは多様で代表的なデータセットを使用して AI モデルをトレーニングする必要があります。 偏見や差別を完全に排除することはほぼ不可能ですが、幅広いデータセットを使用することで、偏見や差別の一部を取り除くことができます。 AI ツールがどのように開発されているかを懸念している消費者の方が、そうでない消費者よりも多く、このトピックに関する透明性があれば、これらのツールに対する消費者の信頼がもう少し高まる可能性があります。

すべてのブランドは偏りのないデータの使用に留意する必要がありますが、特定の業界は他の業界よりも注意する必要があります。 特に銀行やヘルスケアのブランドは、組織的な差別の歴史があるため、AI をどのように使用しているかを十分に認識する必要があります。 私たちのデータによると、特定のコミュニティに害を及ぼす行為は、消費者がブランドをボイコットする最大の理由であり、AI ツールのトレーニングに使用される数テラバイトのデータの中に、潜在的に有害なデータが存在します。

ブランドには、使用されているデータセットの詳細なレビューに加えて、プロセス全体を監督する人間、できれば多様性、公平性、包括性 (DE&I) のトレーニングを受けた人間も必要です。 当社の GWI USA Plus データセットによると、アメリカ人の 70% にとって DE&I は重要であり、価値観を共有するブランドから購入する可能性が高くなります。

4. 職場での自動化と適切なバランスをとる

部屋の中の象に話しかけてみましょう。 AIは労働者にとって味方になるのか、それとも敵になるのか? 私たちが知っているように、AI が仕事を変えることは間違いありませんが、AI が職場にどれほど大きな影響を与えるかは、誰に尋ねるかによって異なります。

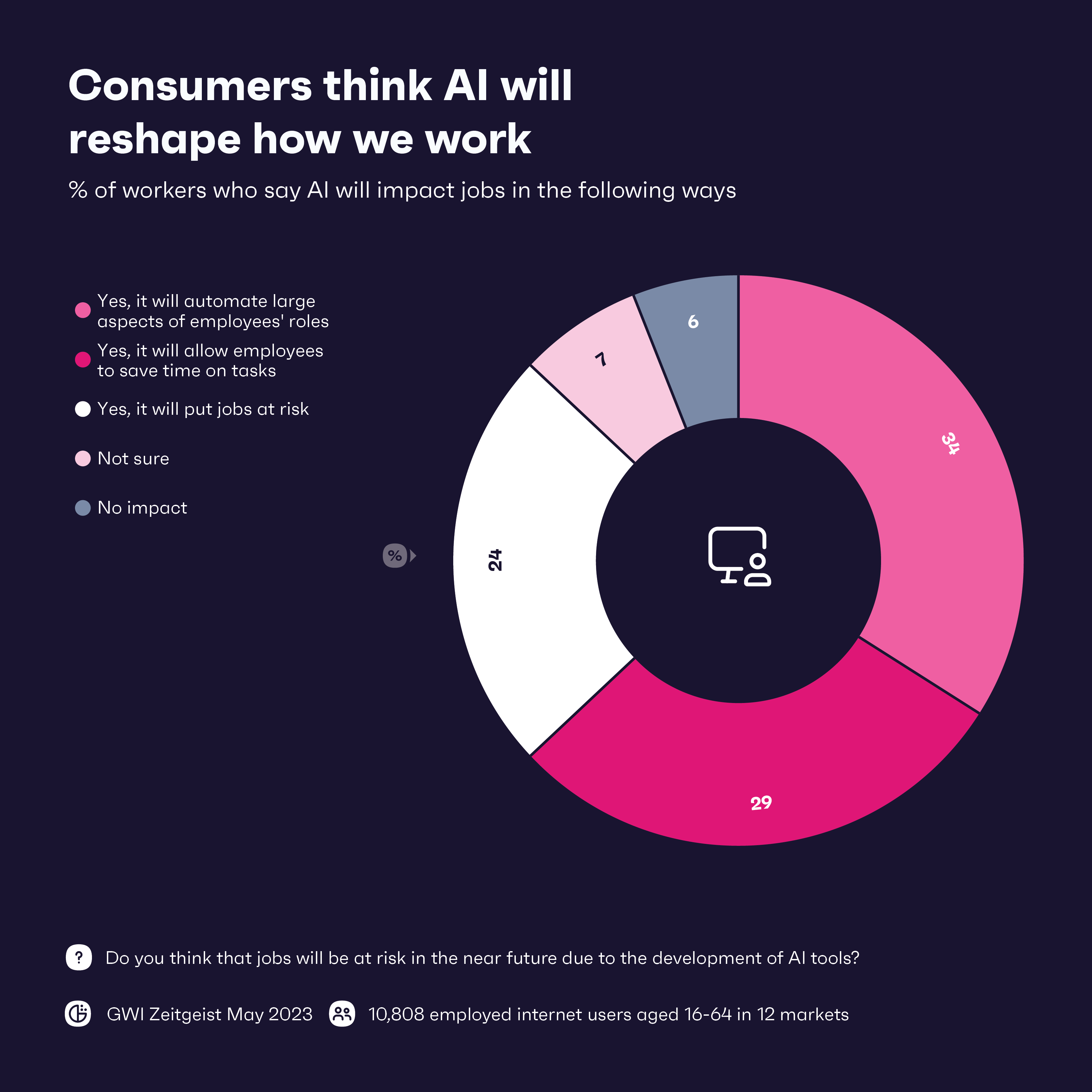

私たちが知っていることは、大多数の労働者が AI が自分たちの仕事に何らかの影響を与えることを期待しているということです。 特にテクノロジー業界や製造/物流業界では、従業員の役割の大部分の自動化が期待されています。 全体として、従業員は AI に興奮しているようで、12 部門中 8 部門が自動化がプラスの影響を与えると述べています。

その一方で、労働者の 25% 近くが AI が雇用への脅威であると考えており、旅行業界や健康・美容業界で働く人々は特に不安を感じています。 生成 AI は毎月指数関数的に進歩しているようです。そこで問題となるのは、AI が日常的なタスクを今すぐ処理できるようになったら、次に何が起こるのかということです。

AI が世界で約 8,000 万人の雇用を奪ったとしても、脆弱な業界であっても労働者は AI を効果的に活用して自分のスキルを向上させる方法を見つけることができます。 顧客サービスはAIによって大幅にアップグレードされる予定ですが、それは人間なしでは実現できません。 生成型 AI はほとんどの問い合わせに対応できますが、機密情報を処理し、共感を持って対応するには人間がそばにいる必要があります。 人間は AI と連携して、よりパーソナライズされたソリューションや推奨事項を提供することもできます。これは旅行業界や美容業界では特に重要です。

AI によって一部のタスクが自動化されると、従業員は他の方法で貢献できるようになります。 戦略的思考と革新的なソリューションの考案に余分な時間を費やすことができ、その結果、新しい製品やサービスが生まれる可能性があります。 企業や業界ごとに異なりますが、AI と人間の労働者の間で適切なバランスを取ることができる人が、AI の時代でも成功するはずです。

最後のプロンプト: 知っておくべきこと

AI は強力ですが、ブランドはリスクを認識する必要があります。 消費者データを保護し、フェイクニュースに注意する必要がある。 透明性が鍵となります。 消費者はAIの将来について不安を感じており、ブランドが倫理的かつ責任ある行動をしていることを消費者に示すことは大いに役立つだろう。

このテクノロジーは刺激的であり、職場全体にプラスの影響を与える可能性があります。 しかし、ブランドは慎重に作業を進め、テクノロジーと人的資本の適切なバランスを取るよう努めるべきです。 従業員は倫理、セキュリティ、適切な適用に関する広範なトレーニングが必要であり、そうすることでスキルが向上します。 AI ツールを完全に置き換えるのではなく、人と協力して機能する AI ツールを統合することで、ブランドはバランスをとり、AI が強化された未来に備えることができます。