Moderacja treści w kampaniach UGC: wszystko, co musisz wiedzieć

Opublikowany: 2023-08-21Jeśli prowadzisz kampanię dotyczącą „prezentu”, możesz pozyskać wiele leadów z lokalizacji anglojęzycznych, ale z Niemiec otrzymasz jedynie raporty i bany. Zastanawiać się dlaczego?

W tym miejscu wkracza moderacja treści, aby uratować sytuację. Teraz, gdy już jesteś przekonany, dlaczego Twoja kampania wymaga moderacji treści, spójrzmy głębiej i zobaczmy, co jeszcze może dla Ciebie zrobić.

Rola moderacji treści

Wszyscy wiemy, że Internet nie ma granic i tutaj idee wędrują swobodnie, ale z tą wolnością wiążą się wyzwania. Rozmowy mogą stać się chaotyczne, a różne poglądy czasami prowadzą do zamieszania.

W tym miejscu wkracza moderacja treści – niczym cyfrowy opiekun.

Nie chodzi tylko o mówienie tak lub nie; chodzi o zapewnienie bezpieczeństwa, umożliwienie usłyszenia głosów i powstrzymanie szkodliwych skutków.

Zapewnienie bezpieczeństwa użytkowników i zdrowia społeczności internetowej:

Moderowanie treści jest niezbędne, aby stworzyć bezpieczne i przyjazne środowisko dla użytkowników. Odfiltrowując szkodliwe treści, cyberprzemoc, mowę nienawiści i inne formy nadużyć, platformy internetowe mogą chronić użytkowników przed poczuciem zagrożenia lub nękania.

Pomaga to budować zaufanie użytkowników, zachęca do aktywnego uczestnictwa i wspiera zdrową społeczność marki.

Równowaga pomiędzy wolnością wypowiedzi i odpowiedzialnym doradztwem w zakresie treści:

Platformy internetowe cenią zasadę wolności wypowiedzi, umożliwiając użytkownikom wyrażanie swoich opinii i dzielenie się przemyśleniami. Jednak tę swobodę należy zrównoważyć odpowiedzialnym zarządzaniem treścią, aby zachować pełne szacunku i włączające środowisko.

Moderowanie treści zapewnia użytkownikom możliwość wyrażania siebie, ale odbywa się to w granicach akceptowalnego zachowania i komunikacji opartej na szacunku.

Ochrona przed szkodliwymi, nielegalnymi lub nieodpowiednimi treściami:

Moderacja treści chroni przed treściami, które mogą wyrządzić krzywdę, rozpowszechniać dezinformację lub naruszać przepisy i regulacje. Zapobiega rozpowszechnianiu nielegalnych materiałów, takich jak treści chronione prawem autorskim, pirackie oprogramowanie i substancje zabronione.

Dodatkowo pomaga chronić użytkowników przed kontaktem z treściami wulgarnymi lub drastycznymi, które mogą być nieodpowiednie dla określonych odbiorców.

Skuteczna moderacja treści polega na połączeniu ludzkich moderatorów i zautomatyzowanych systemów współpracujących w celu osiągnięcia właściwej równowagi między tymi trzema rolami. To delikatne zadanie, które wymaga starannego rozważenia kontekstu, norm kulturowych i ewoluującego charakteru interakcji online.

Rodzaje moderacji treści

Dobra, przejdźmy do moderacji treści! Pomyśl o tym jako o wielowarstwowym procesie, takim jak system bezpieczeństwa dla twoich ulubionych spotkań online. Oto cztery podstawowe odmiany moderacji treści:

Moderacja wstępna: przeglądanie treści przed ich opublikowaniem

Podobnie jak bramkarz sprawdza identyfikatory przy wejściu do klubu, moderacja wstępna polega na skanowaniu treści, zanim trafią one na światło dzienne.

W ten sposób niezbyt fajne rzeczy nigdy nie ujrzą światła dziennego. To jak wirtualna aksamitna lina dla twoich przestrzeni online.

Post-moderacja: monitorowanie i usuwanie treści po publikacji

Post-moderacja jest jak sprzątanie po dużej imprezie. Treść jest najpierw publikowana, a potem ekipa moderacyjna wkracza, by sprawdzić, czy coś wymaga uporządkowania.

Jeśli coś jest nie tak, jest to szybko usuwane. To tak, jakby mieć bystrego woźnego dla świata online.

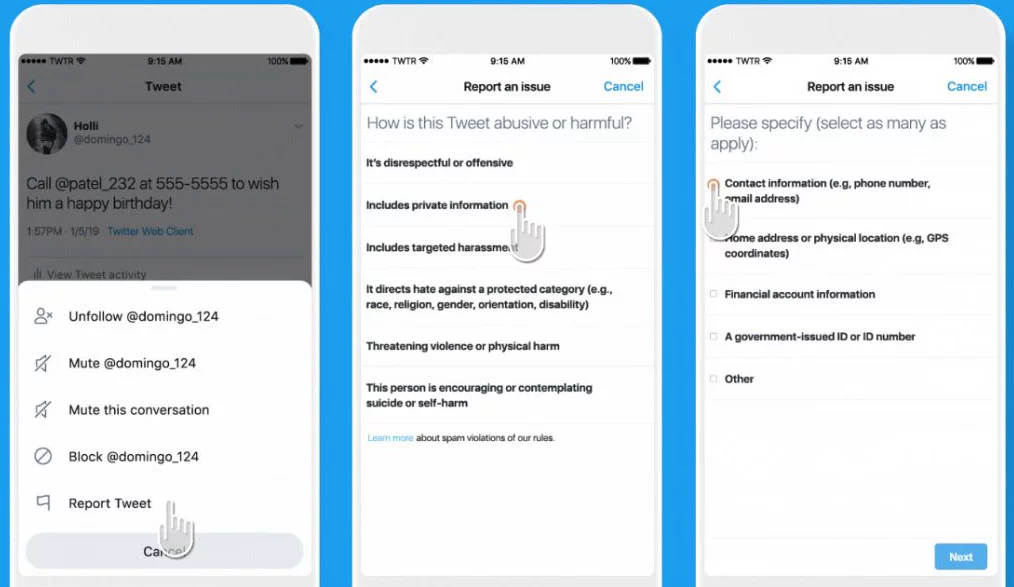

Moderacja reaktywna: odpowiadanie na zgłoszenia użytkowników i opinie

Wyobraź sobie, że jesteś na pikniku i ktoś zauważa gniazdo os. Poinformowałbyś organizatora, prawda? Podobnie moderacja reaktywna polega na tym, że użytkownicy alarmują, gdy widzą problematyczne treści. Następnie zespół moderatorów podejmuje działania, podobnie jak pozbycie się tych nieznośnych os.

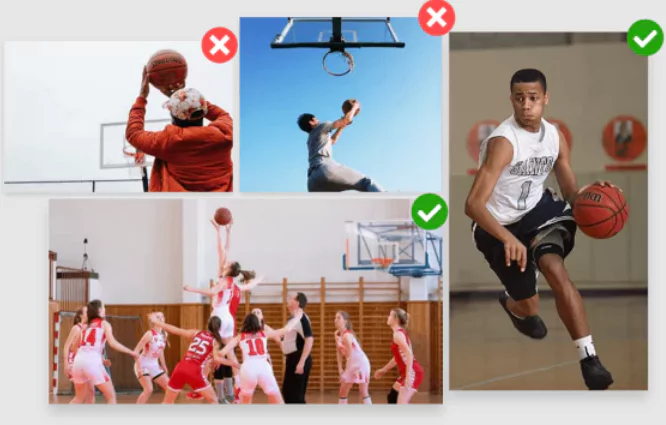

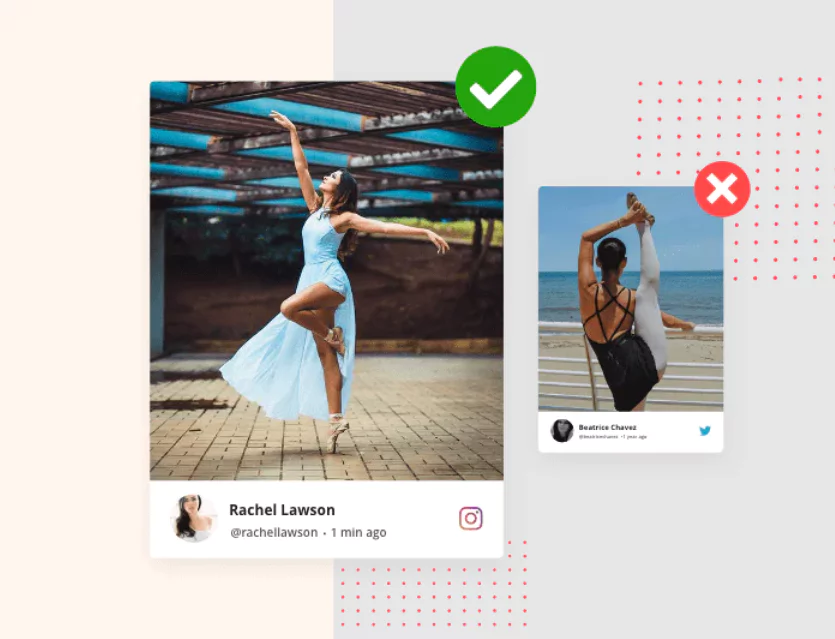

Proaktywna moderacja: wykorzystanie sztucznej inteligencji i algorytmów do wykrywania problematycznych treści

I tu wkraczają kreatorzy technologii. Sztuczna inteligencja i inteligentne algorytmy skanują stosy treści w poszukiwaniu sygnałów ostrzegawczych.

Są jak wirtualne ogary wywęszające wszystko, co nie należy. To jak posiadanie supermocnych okularów, które potrafią wykryć problemy z odległości mili.

Kiedy więc zagłębimy się w moderację treści, pamiętajmy o tych smakach. To sekretny sos, który rozkręca imprezę online, jednocześnie odstraszając trolle i wichrzycieli.

Wyzwania w moderowaniu treści

Porozmawiajmy o wyzwaniach – przeszkodach, z którymi zespoły moderujące treści radzą sobie jak cyfrowi superbohaterowie. Wyobraź sobie, że próbujesz utrzymać pod kontrolą ogromną publiczność koncertową – trochę tak jest, tylko w świecie online.

Oto cztery największe:

Skala: radzenie sobie z ogromnymi ilościami treści generowanych przez użytkowników

Pomyśl, ile rzeczy ludzie udostępniają w Internecie co sekundę. Teraz wyobraź sobie, że przeglądasz to wszystko i dostrzegasz wszelkie niesforne zachowania. Na tym polega wyzwanie skali.

Zespoły moderujące treści muszą obsługiwać niekończący się strumień postów, komentarzy, filmów i nie tylko. To jakby policzyć gwiazdy na niebie – nie lada wyczyn!

Subiektywność: poruszanie się po różnicach kulturowych i różnorodnych perspektywach

Czy kiedykolwiek miałeś przyjacielską debatę, podczas której zdałeś sobie sprawę, że ktoś inny widzi rzeczy zupełnie inaczej? A teraz wyobraźcie sobie to w skali globalnej.

Treść można interpretować na wiele sposobów, w zależności od kultury, pochodzenia i osobistych poglądów. Moderatorzy muszą balansować na granicy i upewnić się, że te same zasady obowiązują sprawiedliwie wszystkich, bez względu na to, skąd pochodzą.

Kontekst: zrozumienie intencji treści w celu dokładnej moderacji

Słowa mogą być trudne. „Fajne” może oznaczać doskonałe lub chłodne, w zależności od kontekstu. Podobnie zrozumienie, czy post ma być zabawny, informacyjny czy obraźliwy, może być trudne.

Zespoły moderujące treść bawią się w detektywa, próbując dowiedzieć się, co należy rozumieć pod pojęciem nieszkodliwego przekomarzania się, a co przekracza granicę.

Pojawiające się trendy: zajmowanie się nowymi formami treści (np. Deepfake)

Pamiętasz, jak Twój ulubiony superbohater dostosowuje się do nowych złoczyńców? Cóż, moderatorzy treści stają w obliczu własnego, ewoluującego wroga: nowych typów treści.

Na przykład Deepfakes działają jak cyfrowa zmiana kształtu, przez co trudno odróżnić rzeczywistość od podróbki. Moderacja treści musi nadążać za tymi trendami, aby być o krok przed innymi.

Gdy zagłębimy się w świat moderacji treści, pamiętaj o tych wyzwaniach. To łamigłówki, które moderatorzy rozwiązują codziennie, aby nasze przestrzenie internetowe były bezpieczne, pełne szacunku i przyjemne. Aby ułatwić Ci to zadanie, pozwól, że przedstawię Ci Tagbox - narzędzie, które nie tylko pomaga w moderowaniu treści, ale także w gromadzeniu, zarządzaniu i prezentowaniu treści generowanych przez użytkowników we wszystkich marketingowych punktach styku.

Strategie moderowania treści

W porządku, rozbijmy to. Wyobraź sobie moderację treści jak pracę zespołową – ludzie i technologia łączą siły, aby świat online był niesamowity. Oto ciekawostka o tym, jak oni to robią:

Umiarkowanie ludzkie

To tak, jakbyś miał czujnych kumpli, którzy opiekują się tobą w cyfrowym sąsiedztwie. Sprawdź, czym się zajmują:

- Znaczenie dobrze wyszkolonych i zróżnicowanych zespołów moderacyjnych:

Różni ludzie w zespole oznaczają różne perspektywy. Pomaga to wyłapać trudne rzeczy, których maszyny mogą nie złapać. Podobnie jak posiadanie przyjaciół z całego świata, aby zachować równowagę.

- Ustanawianie jasnych wytycznych i protokołów:

Potraktuj je jak zasady, dzięki którym wszyscy będą grać uczciwie. Moderatorzy przestrzegają tych zasad, aby zdecydować, czy treść jest odpowiednia. To tak, jakby mieć zasady gry na internetowym placu zabaw.

- Radzenie sobie z obciążeniem psychicznym moderatorów:

Oglądanie przez cały dzień niezbyt przyjemnych rzeczy może być trudne. Moderatorzy potrzebują wsparcia, aby zachować spokój. W końcu to oni są bohaterami dbającymi o czystość i bezpieczeństwo.

Sztuczna inteligencja i automatyzacja

Teraz poznaj cyfrowych pomocników, którzy pomogą:

- Rola uczenia maszynowego w wykrywaniu treści:

Maszyny uczą się wzorców, tak jak Twoje zwierzę uczy się, gdzie są smakołyki. Dostrzegają rzeczy, które mogą nie pasować, przetwarzając tony informacji. Świetnie nadaje się do obsługi dużej ilości treści.

- Korzyści i ograniczenia automatycznej moderacji:

Maszyny są sprytne, ale nie doskonałe. Czasami przegapiają trudne rzeczy lub przez pomyłkę podnoszą flagę. Są jak zaufani kumple, którzy czasami potrzebują pomocy.

- Ciągła potrzeba nadzoru ze strony człowieka:

Ludzie mają tajemne maszyny mocy, których brakuje – zrozumienia uczuć i trudnych sytuacji. Podwójnie sprawdzają, co znajdują maszyny, aby upewnić się, że wszystko jest na swoim miejscu.

Gdy zagłębisz się w moderację treści, pamiętaj o wysiłku zespołowym. Ludzie i technologia sprawiają, że świat online pozostaje przyjazny, zabawny i pełen szacunku.

Przyszłość moderacji treści

Gotowy zajrzeć do kryształowej kuli moderowania treści? Przyszłość niesie ze sobą ekscytujące możliwości, które ukształtują sposób, w jaki spędzamy czas online. Sprawdź, co widać na horyzoncie:

- Postęp w sztucznej inteligencji i technologii:

Wyobraź sobie, że technologia staje się jeszcze mądrzejsza, tak jak Twój zwierzak uczy się nowych sztuczek. Sztuczna inteligencja będzie lepiej wykrywać trudne treści, dzięki czemu świat online będzie bezpieczniejszy. Mówimy o superinteligentnych algorytmach, które potrafią odczytywać emocje i rozumieć kontekst jak prawdziwi profesjonaliści.

- Współpraca między platformami, decydentami i użytkownikami:

Wyobraź sobie zbierającą się drużynę superbohaterów. Platformy internetowe, ludzie ustalający zasady i my – użytkownicy – będziemy pracować ramię w ramię. Oznacza to sensowne zasady i internetowy plac zabaw, w którym każdy pomaga zachować czystość.

- Edukacja użytkowników i odpowiedzialność za przyczynianie się do bezpiecznego środowiska cyfrowego:

Wyobraź sobie, że wszyscy zostajemy cyfrowymi superbohaterami. Jako użytkownicy dowiemy się, co jest fajne, a nie w świecie online. Podobnie jak ucząc się recyklingu, przyczynimy się do czystszej, milszej przestrzeni cyfrowej, będąc odpowiedzialnymi internautami.

Przygotuj się więc na przyszłość, w której technologia stanie się mądrzejsza, platformy i ludzie połączą siły, aby zapewnić lepsze doświadczenia online, a wszyscy wniosą swój wkład, aby upewnić się, że świat cyfrowy pozostanie zabawny, pełen szacunku i radosny dla wszystkich.

Wniosek

Uff, to była niezła eksploracja! Podsumujmy wszystko na temat moderacji treści i tego, co nas czeka:

Pamiętasz tych niedocenionych bohaterów pracujących za kulisami? Dzięki moderacji treści nasze cyfrowe spotkania są czyste, bezpieczne i pełne pozytywnych wibracji. To tak, jakby mieć niewidzialne ręce, które zapewniają wszystkim dobrą zabawę.

Zmiana jest stała, a świat online nie jest wyjątkiem. Moderacja treści będzie ewoluować wraz z pojawianiem się nowych trendów i wyzwań. Zachowaj ciekawość i otwarty umysł, ponieważ podróż jeszcze się nie skończyła.

Kończąc, wznieśmy wirtualny toast za cyfrowych superbohaterów – moderatorów, czarodziejów technologii i odpowiedzialnych użytkowników – którzy sprawiają, że świat online jest przyjazną przystanią dla różnorodnych głosów, twórczej ekspresji i pełnych szacunku interakcji.

Oto przyszłość, w której świat online odzwierciedla to, co najlepsze w ludzkości – życzliwość, zrozumienie i jedność. Kontynuuj odkrywanie, ucz się i rozpowszechniaj cyfrową miłość!