Wysokie ryzyko, wysoka nagroda: jak marki mogą etycznie wykorzystywać sztuczną inteligencję

Opublikowany: 2023-07-18Generatywna sztuczna inteligencja już zmieniła świat, ale nie wszystko złoto, co się świeci. Podczas gdy zainteresowanie konsumentów takimi rozwiązaniami jak ChatGPT jest duże, zarówno eksperci, jak i konsumenci są coraz bardziej zaniepokojeni zagrożeniami, jakie sztuczna inteligencja stanowi dla społeczeństwa. Obawy związane z utratą pracy, bezpieczeństwem danych, dezinformacją i dyskryminacją to tylko niektóre z głównych obszarów powodujących niepokój.

Sztuczna inteligencja to najszybciej rosnący strach w Stanach Zjednoczonych, o 26% więcej niż zaledwie kwartał temu.

Sztuczna inteligencja bez wątpienia zmieni sposób, w jaki pracujemy, ale firmy muszą być świadome związanych z tym problemów. Na tym blogu przyjrzymy się obawom konsumentów związanych z bezpieczeństwem pracy i danych, jak marki mogą złagodzić obawy i chronić zarówno siebie, jak i konsumentów przed potencjalnymi zagrożeniami.

1. Ochrona generatywnej sztucznej inteligencji

Treści generowane przez sztuczną inteligencję, takie jak ChatGPT i twórca obrazów DALL-E, szybko stają się częścią codziennego życia, a ponad połowa konsumentów widzi treści generowane przez sztuczną inteligencję co najmniej raz w tygodniu. Ponieważ narzędzia te wymagają ogromnych ilości danych do uczenia się i generowania odpowiedzi, do miksu mogą wkraść się poufne informacje.

Dzięki wielu ruchomym częściom generatywne platformy sztucznej inteligencji pozwalają użytkownikom współtworzyć kod na różne sposoby w nadziei na poprawę procesów i wydajności. Minusem jest to, że przy wielu współuczestnikach luki w zabezpieczeniach często pozostają niezauważone, a dane osobowe mogą zostać ujawnione. Dokładnie taka sytuacja miała miejsce w przypadku ChatGPT na początku maja 2023 r.

Ponieważ ponad połowa konsumentów twierdzi, że naruszenie ochrony danych spowodowałoby bojkot marki, prywatność danych musi być traktowana priorytetowo. Podczas gdy podejmowane są kroki w celu napisania przepisów dotyczących sztucznej inteligencji, w międzyczasie marki muszą samodzielnie narzucić zasady przejrzystości i wytyczne dotyczące użytkowania oraz podać je do wiadomości publicznej.

2 na 3 konsumentów chce, aby firmy tworzące narzędzia sztucznej inteligencji informowały o tym, w jaki sposób są opracowywane.

W ten sposób możesz zbudować zaufanie do marki, która jest obecnie szczególnie pożądaną walutą. Oprócz jakości bezpieczeństwo danych jest najważniejszym czynnikiem, jeśli chodzi o zaufanie do marek. Ponieważ lojalność wobec marki jest coraz bardziej krucha, marki muszą zapewniać konsumentów, że ich dane są w dobrych rękach.

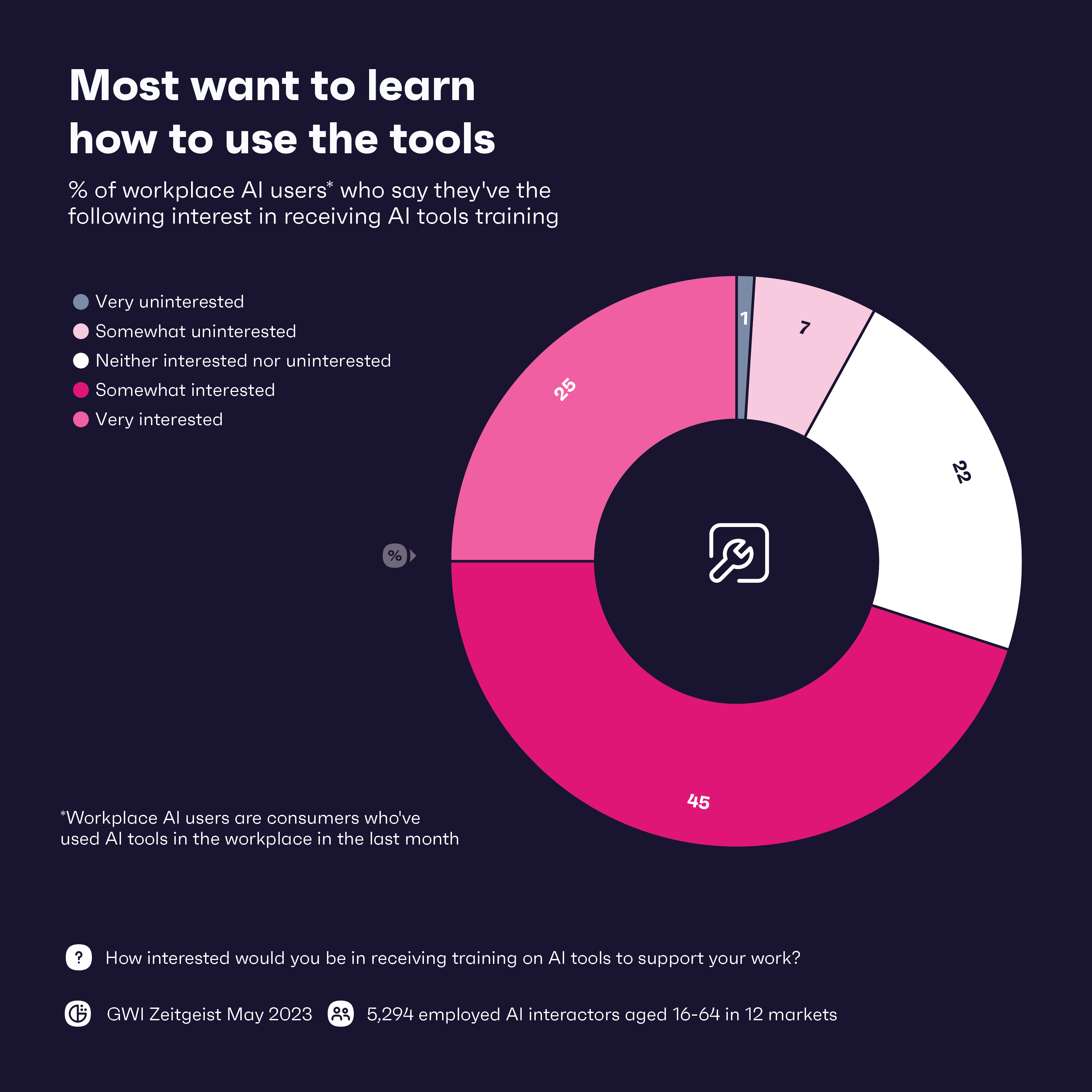

Jaki jest więc jeden z najlepszych sposobów zabezpieczania danych w dobie sztucznej inteligencji? Pierwszą linią obrony jest szkolenie personelu w zakresie narzędzi sztucznej inteligencji, przy czym 71% pracowników deklaruje zainteresowanie szkoleniem. Równie ważne jest połączenie tego ze szkoleniem w zakresie ochrony danych. Edukacja jest tutaj naprawdę kluczowa – uzbrojenie pracowników w wiedzę potrzebną do zapewnienia prywatności danych jest priorytetem.

2. Utrzymywanie autentyczności w świecie fałszywych wiadomości

Facebook potrzebował 4,5 roku, aby dotrzeć do 100 milionów użytkowników. Dla porównania, ChatGPT potrzebował nieco ponad dwóch miesięcy, aby osiągnąć ten kamień milowy.

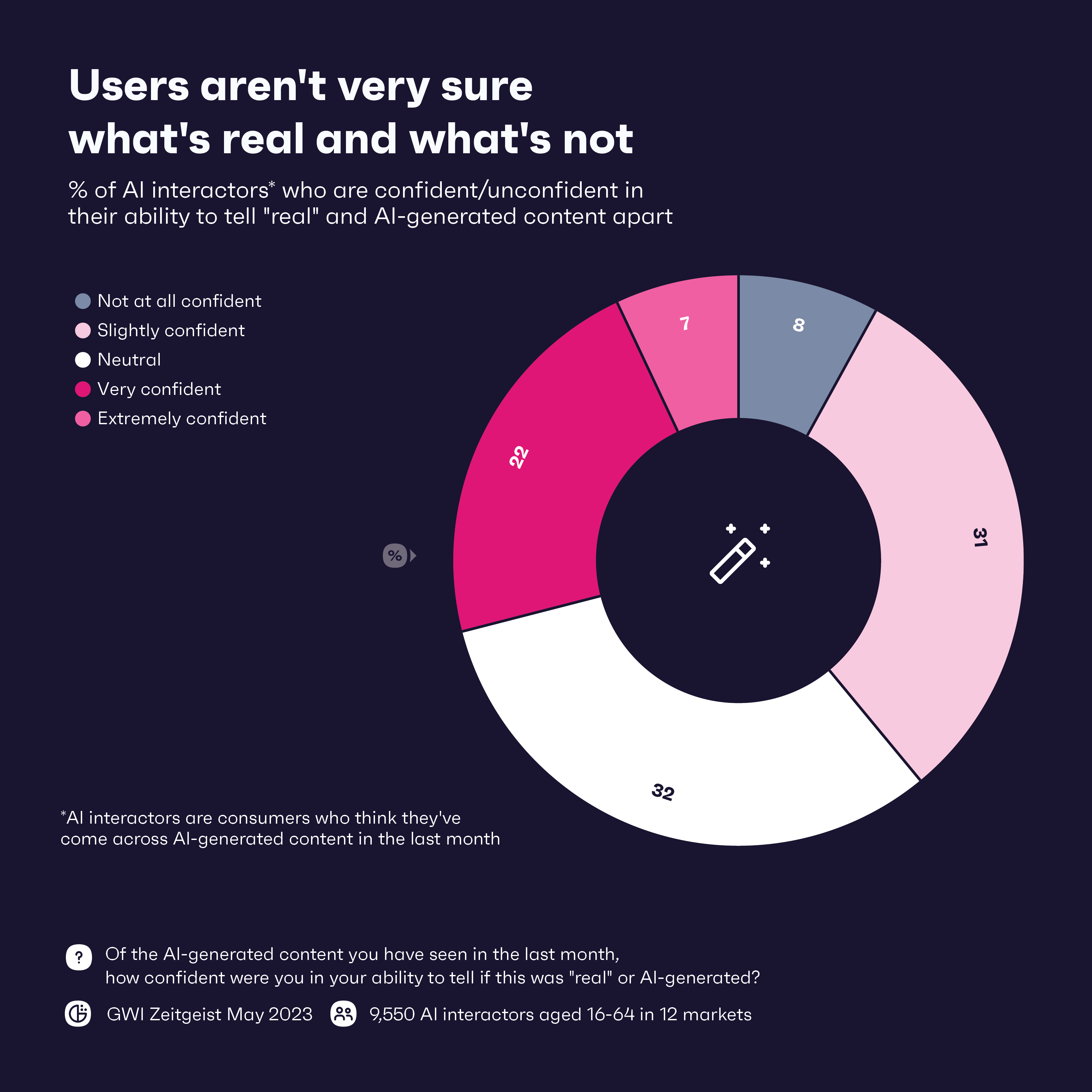

Jakkolwiek imponujący jest wzrost generatywnej sztucznej inteligencji, stał się on magnesem dla tworzenia fałszywych wiadomości w postaci audio i wideo, znanych jako deepfake. Technologia ta była już wykorzystywana do rozpowszechniania dezinformacji na całym świecie. Tylko 29% konsumentów jest przekonanych o swojej zdolności do odróżniania treści generowanych przez sztuczną inteligencję od treści „prawdziwych”, co prawdopodobnie będzie się pogarszać wraz ze wzrostem wyrafinowania deepfake’ów.

Prawie dwie trzecie użytkowników ChatGPT twierdzi, że wchodzi w interakcje z narzędziem tak, jak z prawdziwą osobą, co pokazuje, jak potencjalnie przekonujące może być to narzędzie.

Ale konsumenci widzieli, że to nadchodzi; 64% twierdzi, że obawia się, że narzędzia sztucznej inteligencji mogą być wykorzystywane do nieetycznych celów. Z tą obawą i niskim zaufaniem do wykrywania deepfake, to marki mogą mieć znaczenie w ochronie konsumentów przed najnowszą falą fałszywych wiadomości i zapewnianiu edukacji, jak identyfikować takie treści.

Marki mogą zacząć od wdrożenia weryfikacji źródła i przeprowadzenia analizy due diligence wszelkich informacji, które chcą udostępniać lub promować. W tym samym duchu mogą współpracować lub korzystać z wewnętrznych procesów sprawdzania faktów w dowolnych wiadomościach, które mogą otrzymać. W przypadku większości marek środki te prawdopodobnie już obowiązują, ponieważ fałszywe wiadomości i dezinformacje szerzą się od lat.

Jednak w miarę jak deepfake staje się coraz inteligentniejszy, marki będą musiały nad tym zapanować. Aby ich pokonać, marki mogą ponownie zwrócić się do sztucznej inteligencji w postaci narzędzi do wykrywania opartych na sztucznej inteligencji, które mogą identyfikować i oznaczać treści generowane przez sztuczną inteligencję. Narzędzia te staną się koniecznością w dobie sztucznej inteligencji, ale mogą nie wystarczyć, ponieważ źli aktorzy są zwykle o krok do przodu. Ale połączenie narzędzi do wykrywania i nadzoru ludzkiego w celu prawidłowej interpretacji kontekstu i wiarygodności może udaremnić najgorsze.

Kluczowa jest również przejrzystość. Poinformowanie konsumentów, że robisz coś, aby poradzić sobie z fałszywymi wiadomościami generowanymi przez sztuczną inteligencję, może zdobyć u nich punkty zaufania i pomóc w ustanowieniu standardów branżowych, które mogą pomóc wszystkim w walce z deepfake'ami.

3. Zwalczanie nieodłącznych uprzedzeń

Nikt nie chce koszmaru PR, ale jest to realna możliwość, jeśli marki nie sprawdzają podwójnie i potrójnie informacji, które otrzymują ze swoich narzędzi AI. Pamiętaj, że narzędzia sztucznej inteligencji uczą się na podstawie danych zebranych z Internetu – danych pełnych ludzkich uprzedzeń, błędów i dyskryminacji.

Aby tego uniknąć, marki powinny wykorzystywać różnorodne i reprezentatywne zestawy danych do trenowania modeli AI. Chociaż całkowite wyeliminowanie uprzedzeń i dyskryminacji jest prawie niemożliwe, korzystanie z szerokiego zakresu zestawów danych może pomóc wyeliminować niektóre z nich. Więcej konsumentów jest zaniepokojonych tym, jak rozwijane są narzędzia AI, a pewna przejrzystość w tym temacie może sprawić, że będą bardziej ufać tym narzędziom.

Podczas gdy wszystkie marki powinny dbać o wykorzystywanie bezstronnych danych, niektóre branże muszą być bardziej ostrożne niż inne. W szczególności marki z sektora bankowości i opieki zdrowotnej muszą być bardzo świadome tego, w jaki sposób wykorzystują sztuczną inteligencję, ponieważ branże te mają historię systemowej dyskryminacji. Według naszych danych zachowania, które wyrządzają szkodę określonym społecznościom, są głównym powodem, dla którego konsumenci bojkotują markę, a w terabajtach danych wykorzystywanych do szkolenia narzędzi sztucznej inteligencji znajdują się dane potencjalnie szkodliwe.

Oprócz szczegółowego przeglądu wykorzystywanych zestawów danych, marki potrzebują również ludzi, najlepiej przeszkolonych w zakresie różnorodności, równości i integracji (DE&I), aby nadzorować cały proces. Według naszego zbioru danych GWI USA Plus, DE&I jest ważny dla 70% Amerykanów, którzy chętniej kupują od marek, które podzielają ich wartości.

4. Znalezienie właściwej równowagi z automatyzacją w miejscu pracy

Zwróćmy się do słonia w pokoju. Czy sztuczna inteligencja będzie przyjacielem czy wrogiem pracowników? Nie ma wątpliwości, że zmieni to pracę, jaką znamy, ale to, jak duży będzie wpływ sztucznej inteligencji na miejsce pracy, zależy od tego, kogo zapytasz.

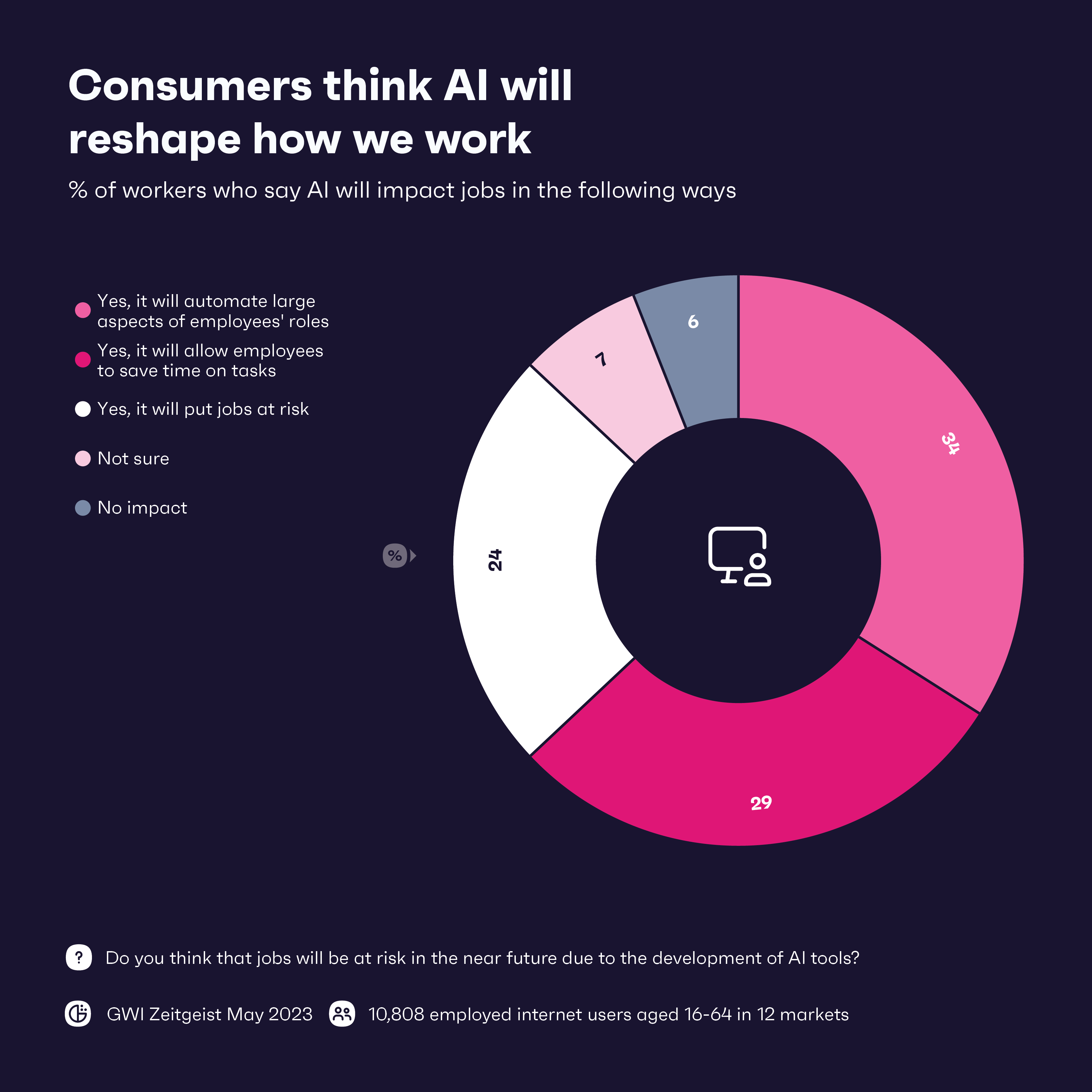

Wiemy natomiast, że znaczna większość pracowników oczekuje, że sztuczna inteligencja będzie miała jakiś wpływ na ich pracę. Oczekiwana jest automatyzacja wielu aspektów ról pracowniczych, zwłaszcza w branży technologicznej i produkcyjnej/logistyce. Ogólnie rzecz biorąc, pracownicy wydają się być podekscytowani sztuczną inteligencją, a 8 z 12 sektorów twierdzi, że automatyzacja będzie miała pozytywny wpływ.

Z drugiej strony prawie 25% pracowników postrzega sztuczną inteligencję jako zagrożenie dla miejsc pracy, a osoby pracujące w branży turystycznej oraz branży zdrowia i urody są szczególnie zdenerwowane. Wydaje się, że generatywna sztuczna inteligencja poprawia się wykładniczo każdego miesiąca, więc pytanie brzmi: jeśli sztuczna inteligencja może teraz zająć się przyziemnymi zadaniami, co będzie dalej?

Nawet jeśli sztuczna inteligencja zabierze około 80 milionów miejsc pracy na całym świecie, pracownicy mogą znaleźć sposoby na efektywne wykorzystanie sztucznej inteligencji do podnoszenia własnych umiejętności, nawet w branżach wrażliwych. Obsługa klienta ma zostać poddana poważnym ulepszeniom dzięki sztucznej inteligencji, ale nie może się to odbyć bez ludzi. Generatywna sztuczna inteligencja może poradzić sobie z większością zapytań, ale ludzie muszą być na miejscu, aby przetwarzać poufne informacje i zapewniać empatyczny kontakt. Ludzie mogą również współpracować z AI, aby dostarczać bardziej spersonalizowane rozwiązania i rekomendacje, co jest szczególnie ważne w branży turystycznej i kosmetycznej.

Sztuczna inteligencja automatyzująca niektóre zadania może zwolnić pracowników, aby mogli wnosić wkład w inny sposób. Mogą poświęcić dodatkowy czas na myślenie strategiczne i wymyślanie innowacyjnych rozwiązań, które mogą zaowocować nowymi produktami i usługami. W każdej firmie i branży będzie inaczej, ale ci, którzy są w stanie znaleźć właściwą równowagę między sztuczną inteligencją a ludzkimi pracownikami, powinni dobrze prosperować w dobie sztucznej inteligencji.

Ostatni monit: Co musisz wiedzieć

Sztuczna inteligencja może być potężna, ale marki muszą być świadome ryzyka. Będą musieli chronić dane konsumentów i być świadomi fałszywych wiadomości. Kluczowa będzie przejrzystość. Konsumenci są zaniepokojeni przyszłością sztucznej inteligencji, a marki pokazujące im, że zachowują się etycznie i odpowiedzialnie, zajdą daleko.

Technologia jest ekscytująca i prawdopodobnie będzie miała pozytywny wpływ na całe miejsce pracy. Ale marki powinny postępować ostrożnie i starać się znaleźć właściwą równowagę między technologią a kapitałem ludzkim. Pracownicy będą potrzebować szeroko zakrojonych szkoleń z zakresu etyki, bezpieczeństwa i właściwego stosowania, a dzięki temu podniosą swoje umiejętności. Integrując narzędzia AI do współpracy z ludźmi, w przeciwieństwie do bezpośredniego ich zastępowania, marki mogą osiągnąć równowagę, która przygotuje je na przyszłość wzmocnioną sztuczną inteligencją.