Risc ridicat, recompensă mare: cum pot mărcile să folosească AI în mod etic

Publicat: 2023-07-18Inteligența artificială generativă a schimbat deja lumea, dar nu tot ce strălucește este aur. Deși interesul consumatorilor față de ChatGPT este mare, există o preocupare tot mai mare atât în rândul experților, cât și al consumatorilor cu privire la pericolele AI pentru societate. Îngrijorările legate de pierderea locurilor de muncă, securitatea datelor, dezinformarea și discriminarea sunt unele dintre principalele domenii care provoacă alarmă.

AI este frica cu cea mai rapidă creștere în SUA, cu 26% în creștere față de doar un sfert în urmă.

Fără îndoială, inteligența artificială va schimba modul în care lucrăm, dar companiile trebuie să fie conștiente de problemele care vin odată cu aceasta. În acest blog, vom explora îngrijorările consumatorilor cu privire la securitatea locurilor de muncă și a datelor, modul în care mărcile pot atenua preocupările și se pot proteja atât pe ei înșiși, cât și pe consumatori de potențiale riscuri.

1. Protejarea IA generativă

Conținutul AI generativ, cum ar fi ChatGPT și creatorul de imagini DALL-E, devine rapid parte din viața de zi cu zi, peste jumătate dintre consumatori văzând conținut generat de AI cel puțin săptămânal. Deoarece aceste instrumente necesită cantități masive de date pentru a învăța și a genera răspunsuri, informațiile sensibile se pot strecura în amestec.

Cu multe părți mobile, platformele AI generative permit utilizatorilor să contribuie la cod în diferite moduri, în speranța de a îmbunătăți procesele și performanța. Dezavantajul este că, cu multe contribuții, vulnerabilitățile trec adesea neobservate, iar informațiile personale pot fi expuse. Această situație exactă este ceea ce s-a întâmplat cu ChatGPT la începutul lui mai 2023.

Cu peste jumătate dintre consumatori spunând că încălcările de date i-ar determina să boicoteze o marcă, confidențialitatea datelor trebuie să fie prioritară. În timp ce se fac pași pentru a scrie legi privind IA, între timp, mărcile trebuie să-și impună singure reguli de transparență și linii directoare de utilizare și să le facă cunoscute publicului.

2 din 3 consumatori doresc ca companiile care creează instrumente AI să fie transparente cu privire la modul în care sunt dezvoltate.

Procedând astfel, se poate construi încrederea în brand, o monedă deosebit de râvnită chiar acum. Pe lângă calitate, securitatea datelor este cel mai important factor atunci când vine vorba de încredere în mărci. Cu loialitatea de marcă din ce în ce mai fragilă, mărcile trebuie să asigure consumatorilor că datele lor sunt pe mâini sigure.

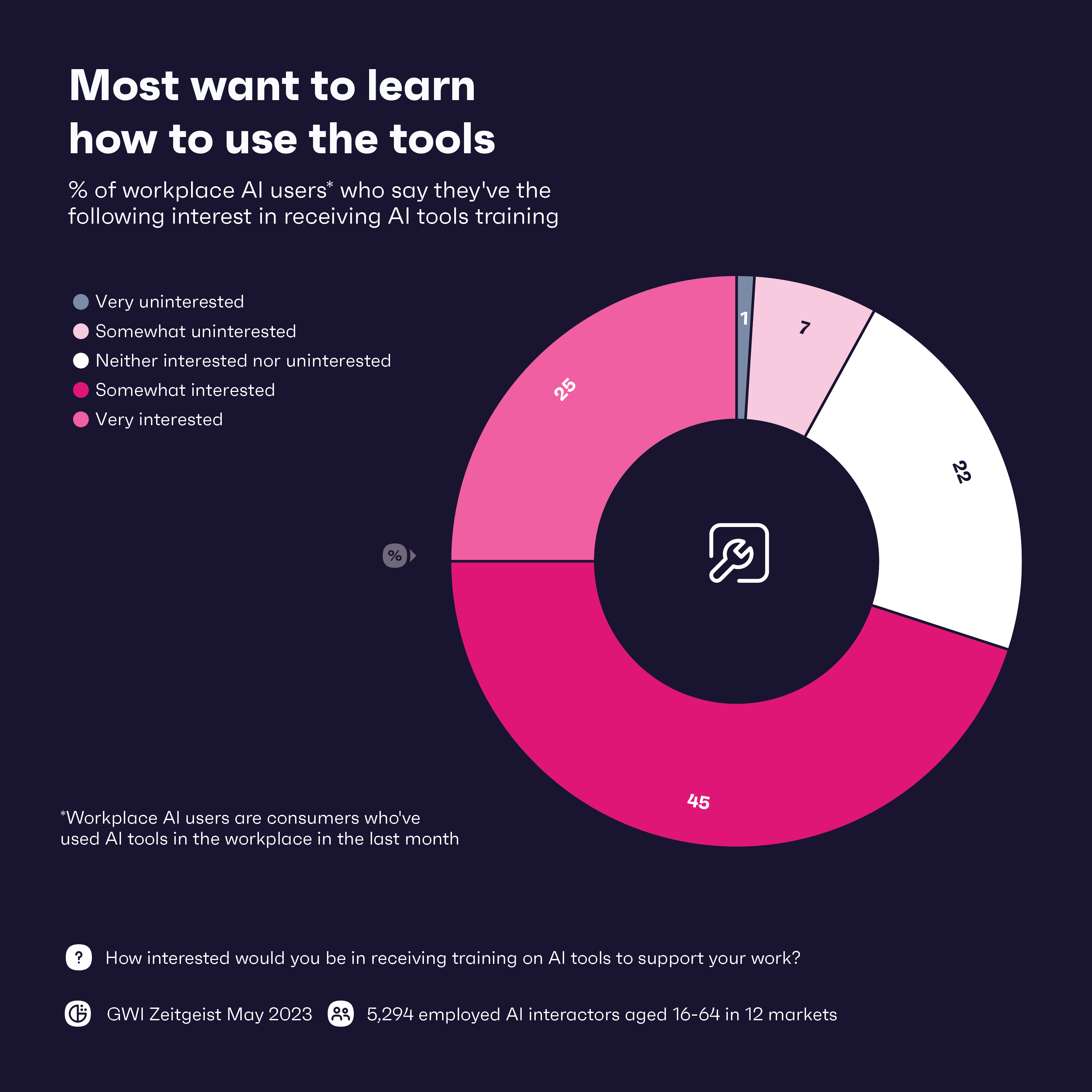

Deci, care este una dintre cele mai bune modalități de a asigura securitatea datelor în era AI? Prima linie de apărare este instruirea personalului în instrumente AI, 71% dintre lucrători spunând că ar fi interesați de formare. Combinarea acestui lucru cu formarea în protecția datelor este la fel de importantă. Educația este cu adevărat esențială aici – înarmarea lucrătorilor cu cunoștințele necesare pentru a asigura confidențialitatea datelor este în prim-plan va fi un drum lung.

2. Menținerea realității într-o lume a știrilor false

Facebook a durat 4,5 ani pentru a ajunge la 100 de milioane de utilizatori. Prin comparație, ChatGPT a avut nevoie de puțin peste două luni pentru a atinge această etapă.

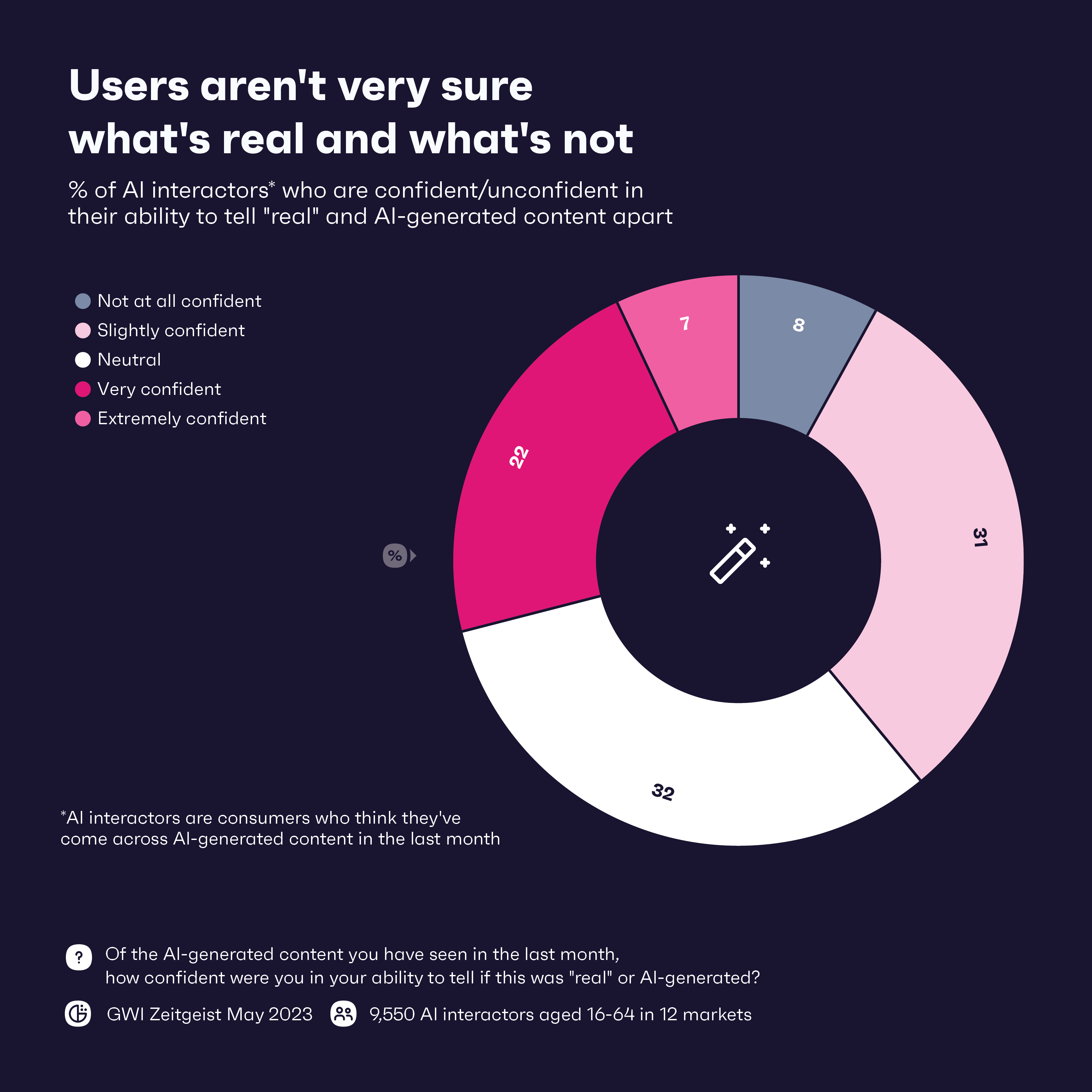

Oricât de impresionantă este creșterea IA generativă, aceasta a fost un magnet pentru crearea de știri false sub formă de audio și videoclipuri, cunoscute sub numele de deepfakes. Tehnologia a fost deja folosită pentru a răspândi dezinformarea în întreaga lume. Doar 29% dintre consumatori sunt încrezători în capacitatea lor de a deosebi conținutul generat de inteligență artificială și conținutul „real”, ceea ce probabil se va înrăutăți pe măsură ce deepfake-urile devin mai sofisticate.

Aproape două treimi dintre utilizatorii ChatGPT spun că interacționează cu instrumentul ca și cum ar face-o cu o persoană reală, ceea ce arată cât de potențial ar putea fi instrumentul.

Dar consumatorii au văzut acest lucru venind; 64% spun că sunt îngrijorați de faptul că instrumentele AI pot fi folosite în scopuri lipsite de etică. Având această îngrijorare și încrederea scăzută în detectarea deepfake-urilor, mărcile sunt cele care pot face diferența în protejarea consumatorilor de acest ultim val de știri false și oferind educație despre cum să identifice un astfel de conținut.

Mărcile pot începe prin implementarea verificării sursei și efectuarea de due diligence asupra oricărei informații pe care doresc să le partajeze sau să le promoveze. În același sens, se pot asocia sau utiliza procese interne de verificare a faptelor pentru orice știri pe care le pot primi. Pentru majoritatea mărcilor, probabil că aceste măsuri vor fi deja în vigoare, deoarece știrile false și dezinformarea au fost răspândite de ani de zile.

Dar, pe măsură ce deepfake-urile devin mai inteligente, mărcile vor trebui să rămână în frunte. Pentru a le învinge, este posibil ca mărcile să fie nevoite să apeleze din nou la AI, sub forma unor instrumente de detectare bazate pe inteligență artificială, care pot identifica și semnala conținutul generat de AI. Aceste instrumente vor deveni o necesitate în era AI, dar s-ar putea să nu fie suficient, deoarece actorii răi sunt de obicei cu un pas înainte. Dar, o combinație de instrumente de detectare și supraveghere umană pentru a interpreta corect contextul și credibilitatea ar putea zădărnici ceea ce este mai rău.

Transparența este, de asemenea, cheia. Informarea consumatorilor să știe că faceți ceva pentru a aborda știrile false generate de inteligență artificială poate obține puncte de încredere cu ei și poate ajuta la stabilirea standardelor din industrie care îi pot ajuta pe toți să rămână în pas împotriva deepfake-urilor.

3. Combaterea părtinirilor inerente

Nimeni nu își dorește un coșmar de PR, dar aceasta este o posibilitate reală dacă mărcile nu verifică de două ori de trei ori informațiile pe care le obțin din instrumentele lor AI. Amintiți-vă, instrumentele AI învață din datele răzuite de pe internet - date care sunt pline de părtiniri umane, erori și discriminare.

Pentru a evita acest lucru, mărcile ar trebui să folosească seturi de date diverse și reprezentative pentru a antrena modele AI. Deși eliminarea completă a prejudecăților și a discriminării este aproape imposibilă, utilizarea unei game largi de seturi de date poate ajuta la eliminarea unora dintre ele. Mai mulți consumatori sunt preocupați de modul în care instrumentele AI sunt dezvoltate decât nu, iar o anumită transparență pe acest subiect i-ar putea face să aibă mai multă încredere în aceste instrumente.

În timp ce tuturor mărcilor ar trebui să le pese de utilizarea datelor imparțiale, anumite industrii trebuie să fie mai atente decât altele. În special, mărcile bancare și din domeniul sănătății trebuie să fie foarte conștiente de modul în care folosesc inteligența artificială, deoarece aceste industrii au o istorie de discriminare sistemică. Conform datelor noastre, comportamentul care dăunează anumitor comunități este principalul motiv pentru care consumatorii ar boicota o marcă, iar în terabytes de date folosiți pentru a instrui instrumentele AI se află date potențial dăunătoare.

Pe lângă o revizuire detaliată a seturilor de date utilizate, mărcile au nevoie și de oameni, de preferință cei cu pregătire diversă, echitate și incluziune (DE&I), pentru a supraveghea întregul proces. Conform setului nostru de date GWI USA Plus, DE&I este important pentru 70% dintre americani și este mai probabil să cumpere de la mărci care își împărtășesc valorile.

4. Găsirea echilibrului potrivit cu automatizarea la locul de muncă

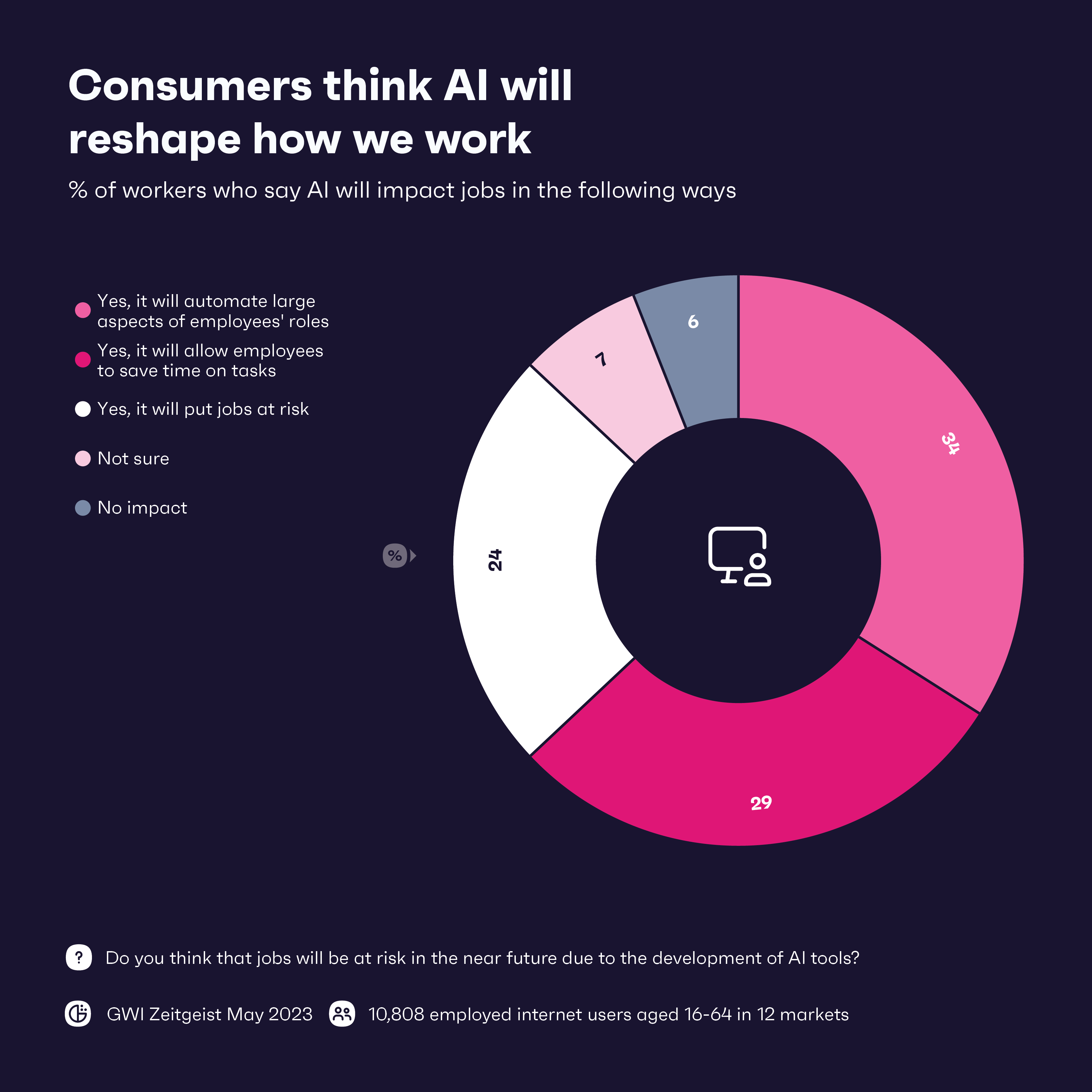

Să ne adresăm elefantului din cameră. Va fi AI un prieten sau un dușman al lucrătorilor? Nu există nicio îndoială că va schimba munca așa cum o știm, dar cât de mare va fi impactul AI asupra locului de muncă depinde de cine întrebi.

Ceea ce știm este că marea majoritate a lucrătorilor se așteaptă ca AI să aibă un fel de impact asupra muncii lor. Este de așteptat automatizarea unor aspecte mari ale rolurilor angajaților, în special în industriile tehnologice și de producție/logistică. În general, lucrătorii par încântați de inteligența artificială, 8 din 12 sectoare spunând că automatizarea va avea un impact pozitiv.

Pe de altă parte, aproape 25% dintre lucrători văd AI ca o amenințare pentru locuri de muncă, iar cei care lucrează în industria călătoriilor și a sănătății și frumuseții sunt deosebit de nervoși. AI generativ pare să se îmbunătățească exponențial în fiecare lună, așa că întrebarea este: dacă AI se poate ocupa acum de sarcinile banale, ce urmează?

Chiar dacă AI ocupă aproximativ 80 de milioane de locuri de muncă la nivel global, lucrătorii pot găsi modalități de a folosi AI în mod eficient pentru a-și îmbunătăți propriile abilități, chiar și în industriile vulnerabile. Serviciul pentru clienți este setat să sufere actualizări majore cu AI, dar nu se poate întâmpla fără oameni. Inteligența artificială generativă poate face față majorității întrebărilor, dar oamenii trebuie să fie acolo pentru a gestiona informațiile sensibile și pentru a oferi o notă empatică. Oamenii pot lucra, de asemenea, cu inteligența artificială pentru a oferi soluții și recomandări mai personalizate, ceea ce este deosebit de important în industria călătoriilor și a frumuseții.

Automatizarea AI a unor sarcini poate elibera lucrătorii să contribuie în alte moduri. Aceștia pot dedica mai mult timp gândirii strategice și găsirii de soluții inovatoare, care ar putea duce la produse și servicii noi. Va fi diferit pentru fiecare companie și industrie, dar cei care sunt capabili să găsească echilibrul potrivit între AI și lucrătorii umani ar trebui să prospere în era AI.

Îndemnul final: Ce trebuie să știți

AI poate fi puternică, dar mărcile trebuie să fie conștiente de riscuri. Ei vor trebui să protejeze datele consumatorilor și să fie conștienți de știrile false. Transparența va fi cheia. Consumatorii sunt îngrijorați de viitorul inteligenței artificiale, iar mărcile care le arată că se comportă etic și responsabil vor merge foarte mult.

Tehnologia este interesantă și va avea probabil un impact pozitiv asupra locului de muncă în general. Dar mărcile ar trebui să procedeze cu prudență și să încerce să atingă echilibrul corect între tehnologie și capitalul uman. Angajații vor avea nevoie de o pregătire extinsă cu privire la etică, securitate și aplicarea corectă, iar acest lucru le va crește abilitățile. Prin integrarea instrumentelor de inteligență artificială pentru a lucra alături de oameni, spre deosebire de înlocuirea lor totală, mărcile pot atinge un echilibru care le va pregăti pentru viitorul îmbunătățit de inteligența artificială.