Высокий риск, высокая награда: как бренды могут использовать ИИ с соблюдением этических норм

Опубликовано: 2023-07-18Генеративный ИИ уже изменил мир, но не все то золото, что блестит. В то время как потребительский интерес к таким продуктам, как ChatGPT, высок, среди экспертов и потребителей растет беспокойство по поводу опасностей ИИ для общества. Беспокойство по поводу потери работы, безопасности данных, дезинформации и дискриминации — вот некоторые из основных областей, вызывающих тревогу.

ИИ — самый быстрорастущий страх в США: он вырос на 26% по сравнению с кварталом ранее.

ИИ, несомненно, изменит то, как мы работаем, но компании должны знать о связанных с ним проблемах. В этом блоге мы рассмотрим опасения потребителей по поводу безопасности работы и данных, а также то, как бренды могут уменьшить беспокойство и защитить себя и потребителей от потенциальных рисков.

1. Защита генеративного ИИ

Генеративный ИИ-контент, такой как ChatGPT и создатель изображений DALL-E, быстро становится частью повседневной жизни: более половины потребителей просматривают ИИ-контент как минимум раз в неделю. Поскольку эти инструменты требуют огромных объемов данных для изучения и генерации ответов, конфиденциальная информация может проникнуть в смесь.

Платформы генеративного ИИ со множеством движущихся частей позволяют пользователям вносить код различными способами в надежде улучшить процессы и производительность. Недостатком является то, что при большом количестве участников уязвимости часто остаются незамеченными, и личная информация может быть раскрыта. Именно такая ситуация произошла с ChatGPT в начале мая 2023 года.

Поскольку более половины потребителей говорят, что утечка данных заставит их бойкотировать бренд, конфиденциальность данных должна быть в приоритете. В то время как предпринимаются шаги по написанию законов об ИИ, тем временем бренды должны сами устанавливать правила прозрачности и рекомендации по использованию и доводить их до сведения общественности.

2 из 3 потребителей хотят, чтобы компании, создающие инструменты искусственного интеллекта, открыто сообщали о том, как они разрабатываются.

Это может укрепить доверие к бренду, что сейчас является особенно желанной валютой. Помимо качества, безопасность данных является наиболее важным фактором, когда речь идет о доверии к брендам. Поскольку лояльность к бренду становится все более хрупкой, бренды должны заверить потребителей, что их данные находятся в надежных руках.

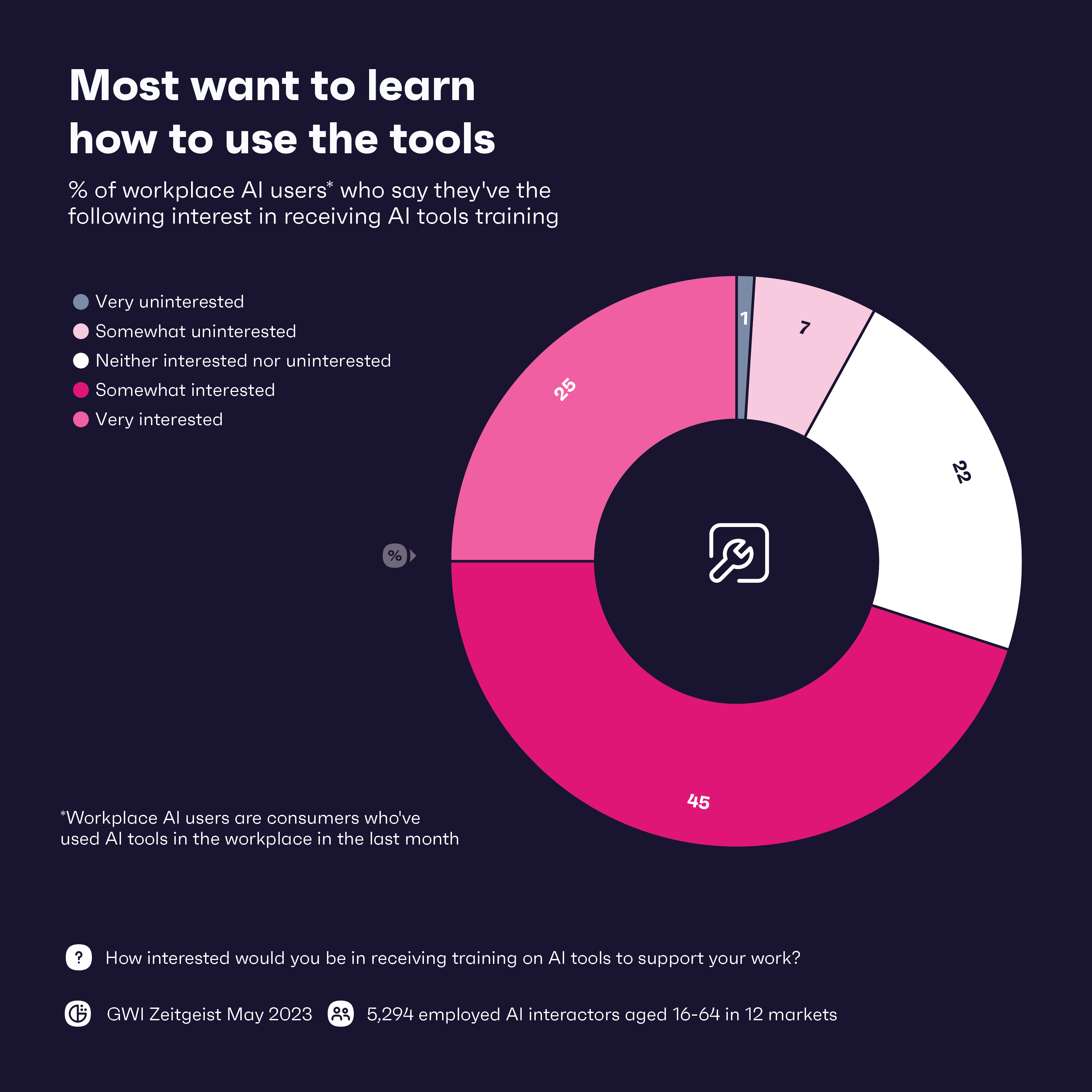

Итак, каков один из лучших способов защиты данных в эпоху ИИ? Первая линия защиты — это обучение персонала инструментам ИИ, при этом 71% работников заявили, что они были бы заинтересованы в обучении. Не менее важно сочетать это с обучением защите данных. Образование здесь действительно играет ключевую роль — вооружение работников знаниями, необходимыми для обеспечения конфиденциальности данных, будет иметь большое значение.

2. Сохраняйте реальность в мире фейковых новостей

Facebook потребовалось 4,5 года, чтобы набрать 100 миллионов пользователей. Для сравнения, ChatGPT потребовалось чуть более двух месяцев, чтобы достичь этого рубежа.

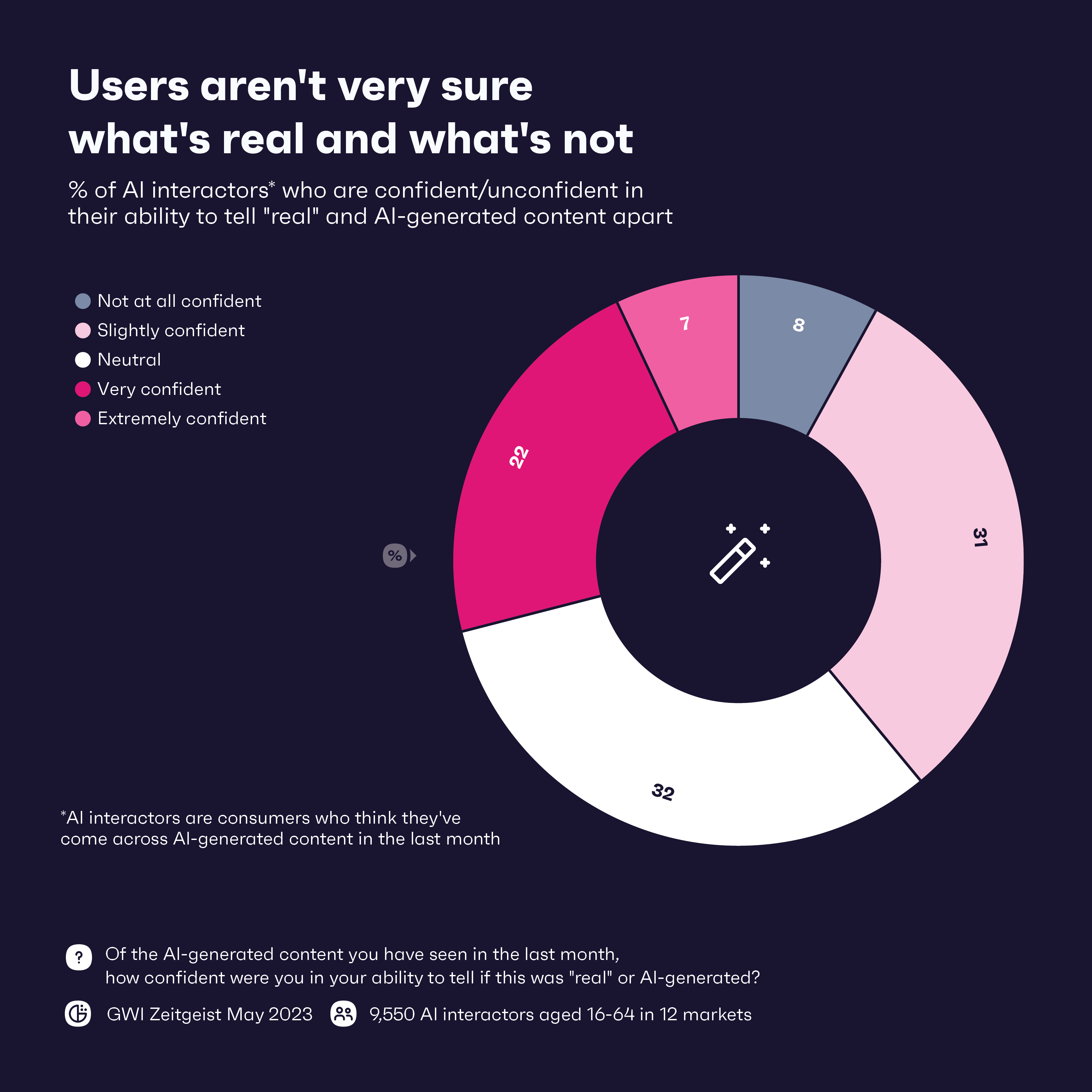

Каким бы впечатляющим ни был рост генеративного ИИ, он стал магнитом для создания фальшивых новостей в виде аудио и видео, известных как дипфейки. Технология уже использовалась для распространения дезинформации по всему миру. Только 29% потребителей уверены в своей способности отличить контент, сгенерированный искусственным интеллектом, от «настоящего», что, вероятно, будет только ухудшаться по мере того, как дипфейки будут становиться все более изощренными.

Почти две трети пользователей ChatGPT говорят, что они взаимодействуют с инструментом, как с реальным человеком, что показывает, насколько потенциально убедительным может быть инструмент.

Но потребители предвидели это; 64% обеспокоены тем, что инструменты ИИ могут использоваться в неэтичных целях. С учетом этой озабоченности и низкой уверенности в обнаружении дипфейков именно бренды могут сыграть решающую роль в защите потребителей от этой последней волны фальшивых новостей и обучении тому, как идентифицировать такой контент.

Бренды могут начать с проверки источника и проведения комплексной проверки любой информации, которой они хотят поделиться или продвигать. В том же духе они могут сотрудничать или использовать внутренние процессы проверки фактов для любых новостей, которые они могут получить. Для большинства брендов эти меры, скорее всего, уже будут приняты, поскольку фейковые новости и дезинформация свирепствуют уже много лет.

Но по мере того, как дипфейки становятся умнее, бренды должны будут держать их в курсе. Чтобы победить их, брендам, возможно, придется снова обратиться к ИИ в виде инструментов обнаружения на основе ИИ, которые могут идентифицировать и помечать контент, созданный ИИ. Эти инструменты станут необходимостью в эпоху ИИ, но их может быть недостаточно, поскольку злоумышленники обычно на шаг впереди. Но сочетание инструментов обнаружения и человеческого надзора для правильной интерпретации контекста и достоверности может предотвратить самое худшее.

Прозрачность также является ключевым фактором. Дайте потребителям понять, что вы делаете что-то для борьбы с фальшивыми новостями, созданными ИИ, и вы заработаете у них очки доверия, а также поможете установить отраслевые стандарты, которые помогут всем идти в ногу с дипфейками.

3. Борьба с врожденными предубеждениями

Никто не хочет пиар-кошмара, но это реальная возможность, если бренды не будут дважды и трижды проверять информацию, которую они получают от своих инструментов искусственного интеллекта. Помните, что инструменты ИИ учатся на данных, собранных из Интернета — данных, полных человеческих предубеждений, ошибок и дискриминации.

Чтобы избежать этого, бренды должны использовать разнообразные и репрезентативные наборы данных для обучения моделей ИИ. Хотя полностью устранить предвзятость и дискриминацию практически невозможно, использование широкого спектра наборов данных может помочь избавиться от некоторых из них. Больше потребителей интересует, как разрабатываются инструменты ИИ, и некоторая прозрачность в этой теме может заставить их доверять этим инструментам немного больше.

Хотя все бренды должны заботиться об использовании объективных данных, некоторые отрасли должны быть более осторожными, чем другие. Банковские и медицинские бренды, в частности, должны быть в курсе того, как они используют ИИ, поскольку эти отрасли имеют историю системной дискриминации. Согласно нашим данным, поведение, причиняющее вред определенным сообществам, является основной причиной, по которой потребители бойкотируют бренд, а в терабайтах данных, используемых для обучения инструментов ИИ, содержатся потенциально опасные данные.

В дополнение к подробному обзору используемых наборов данных, брендам также нужны люди, желательно с обучением разнообразию, справедливости и инклюзивности (DE&I), для наблюдения за всем процессом. Согласно нашему набору данных GWI USA Plus, DE&I важен для 70% американцев, и они с большей вероятностью будут покупать товары у брендов, разделяющих их ценности.

4. Нахождение правильного баланса с автоматизацией на рабочем месте

Давайте обратимся к слону в комнате. Будет ли ИИ другом или врагом для рабочих? Нет сомнений, что это изменит работу, какой мы ее знаем, но насколько велико влияние ИИ на рабочее место, зависит от того, кого вы спросите.

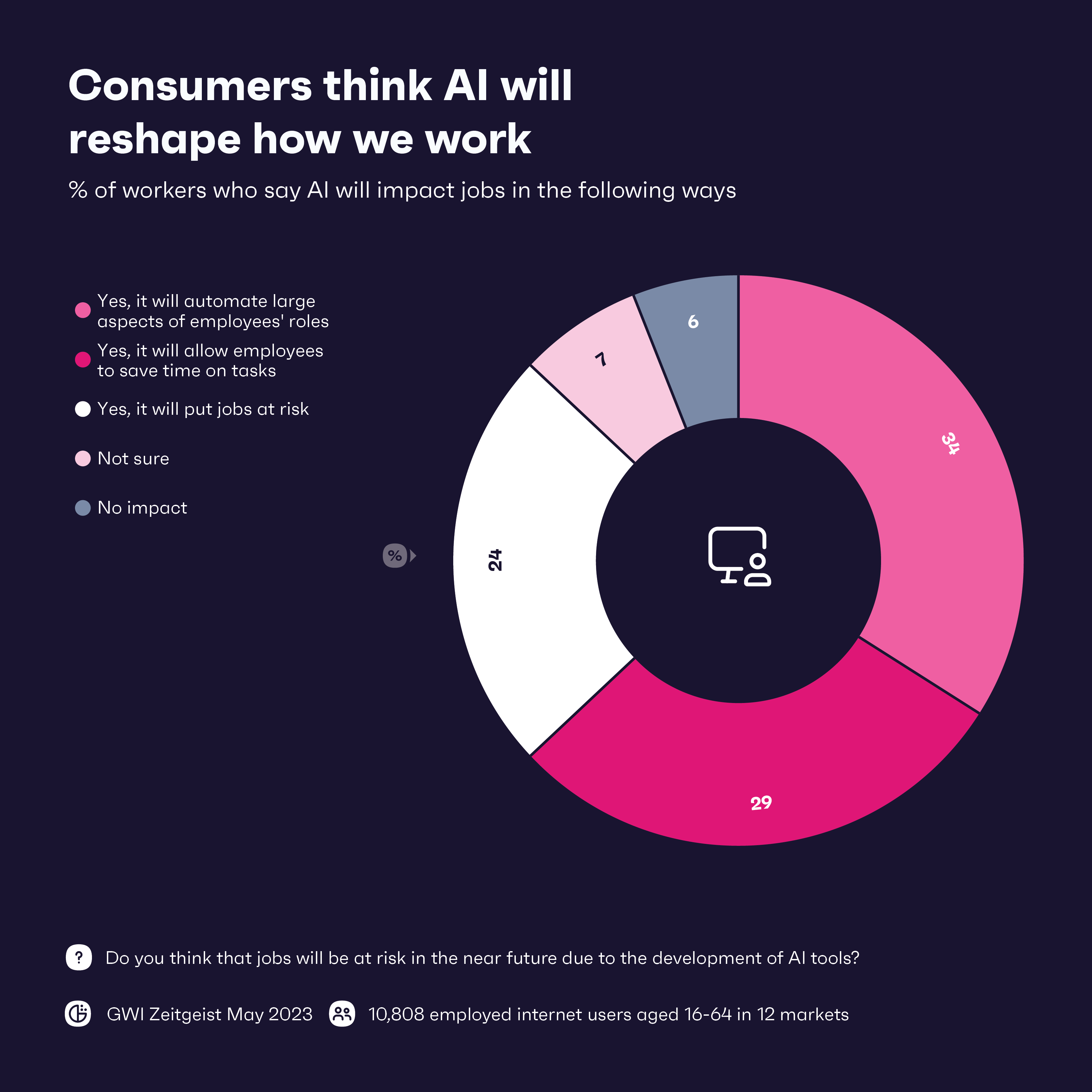

Что мы знаем , так это то, что подавляющее большинство работников ожидают, что ИИ окажет какое-то влияние на их работу. Ожидается автоматизация многих аспектов ролей сотрудников, особенно в технологической и производственной/логистической отраслях. В целом рабочие, похоже, в восторге от ИИ: 8 из 12 секторов говорят, что автоматизация окажет положительное влияние.

С другой стороны, почти 25% работников считают ИИ угрозой для рабочих мест, а те, кто работает в индустрии путешествий, здоровья и красоты, особенно нервничают. Генеративный ИИ, кажется, улучшается в геометрической прогрессии каждый месяц, поэтому возникает вопрос: если ИИ может решать рутинные задачи сейчас, что будет дальше?

Даже если ИИ займет около 80 миллионов рабочих мест во всем мире, работники смогут найти способы эффективно использовать ИИ для повышения своих навыков даже в уязвимых отраслях. Служба поддержки клиентов подвергнется серьезному обновлению с помощью ИИ, но это не может произойти без людей. Генеративный ИИ может справиться с большинством запросов, но люди должны быть рядом, чтобы обрабатывать конфиденциальную информацию и обеспечивать чуткое прикосновение. Люди также могут работать с ИИ для предоставления более персонализированных решений и рекомендаций, что особенно важно в индустрии путешествий и красоты.

ИИ, автоматизирующий некоторые задачи, может высвободить работников для внесения своего вклада другими способами. Они могут посвятить дополнительное время стратегическому мышлению и поиску инновационных решений, которые могут привести к появлению новых продуктов и услуг. Для каждой компании и отрасли он будет разным, но те, кто сможет найти правильный баланс между ИИ и людьми, должны процветать в эпоху ИИ.

Последняя подсказка: что вам нужно знать

ИИ может быть мощным, но бренды должны осознавать риски. Им нужно будет защищать данные потребителей и быть в курсе фейковых новостей. Прозрачность будет иметь ключевое значение. Потребители нервничают по поводу будущего ИИ, и бренды, показывающие им, что они ведут себя этично и ответственно, будут иметь большое значение.

Технология захватывающая и, вероятно, окажет положительное влияние на рабочее место в целом. Но бренды должны действовать осторожно и пытаться найти правильный баланс между технологиями и человеческим капиталом. Сотрудникам потребуется обширное обучение по этике, безопасности и правильному применению, и это повысит их навыки. Интегрируя инструменты ИИ для совместной работы с людьми, а не просто заменяя их, бренды могут найти баланс, который настроит их на будущее с усовершенствованным ИИ.