Yüksek risk, yüksek ödül: Markalar yapay zekayı etik olarak nasıl kullanabilir?

Yayınlanan: 2023-07-18Üretken yapay zeka zaten dünyayı değiştirdi, ancak parıldayan her şey altın değil. ChatGPT'nin beğenilerine tüketici ilgisi yüksek olsa da, hem uzmanlar hem de tüketiciler arasında AI'nın toplum için tehlikeleri konusunda artan bir endişe var. İş kaybı, veri güvenliği, yanlış bilgi ve ayrımcılık endişeleri, alarma neden olan ana alanlardan bazılarıdır.

Yapay zeka, yalnızca çeyrek öncesine göre %26 artışla ABD'de en hızlı büyüyen korku.

Yapay zeka şüphesiz çalışma şeklimizi değiştirecek, ancak şirketlerin onunla birlikte gelen sorunların farkında olması gerekiyor. Bu blogda, iş ve veri güvenliği ile ilgili tüketici endişelerini, markaların endişeleri nasıl giderebileceğini ve hem kendilerini hem de tüketicileri potansiyel risklerden nasıl koruyabileceğini keşfedeceğiz.

1. Üretken yapay zekayı koruma

ChatGPT ve görüntü oluşturucu DALL-E gibi üretken AI içeriği, tüketicilerin yarısından fazlasının AI tarafından oluşturulan içeriği en az haftada bir görmesi ile hızla günlük yaşamın bir parçası haline geliyor. Bu araçlar, öğrenmek ve yanıt oluşturmak için çok büyük miktarda veri gerektirdiğinden, hassas bilgiler karışıma sızabilir.

Pek çok hareketli parçaya sahip üretken yapay zeka platformları, kullanıcıların süreçleri ve performansı iyileştirme umuduyla çeşitli şekillerde koda katkıda bulunmasına olanak tanır. Dezavantajı ise pek çok katkıda bulunurken güvenlik açıklarının genellikle fark edilmemesi ve kişisel bilgilerin açığa çıkmasıdır. Mayıs 2023'ün başlarında ChatGPT'nin başına gelen de tam olarak bu durum.

Tüketicilerin yarısından fazlası veri ihlallerinin bir markayı boykot etmelerine neden olacağını söylerken, veri gizliliğine öncelik verilmesi gerekiyor. AI ile ilgili yasalar yazmak için adımlar atılırken, bu arada markaların şeffaflık kuralları ve kullanım yönergelerini kendileri empoze etmesi ve bunları kamuoyuna duyurması gerekiyor.

Her 3 tüketiciden 2'si, yapay zeka araçları oluşturan şirketlerin bu araçların nasıl geliştirildiği konusunda şeffaf olmasını istiyor.

Bunu yapmak, şu anda özellikle imrenilen bir para birimi olan marka güveni oluşturabilir. Markalara güvenmek söz konusu olduğunda kalitenin yanı sıra veri güvenliği de en önemli faktördür. Marka bağlılığının giderek daha kırılgan hale gelmesiyle, markaların tüketicilere verilerinin emin ellerde olduğuna dair güvence vermesi gerekiyor.

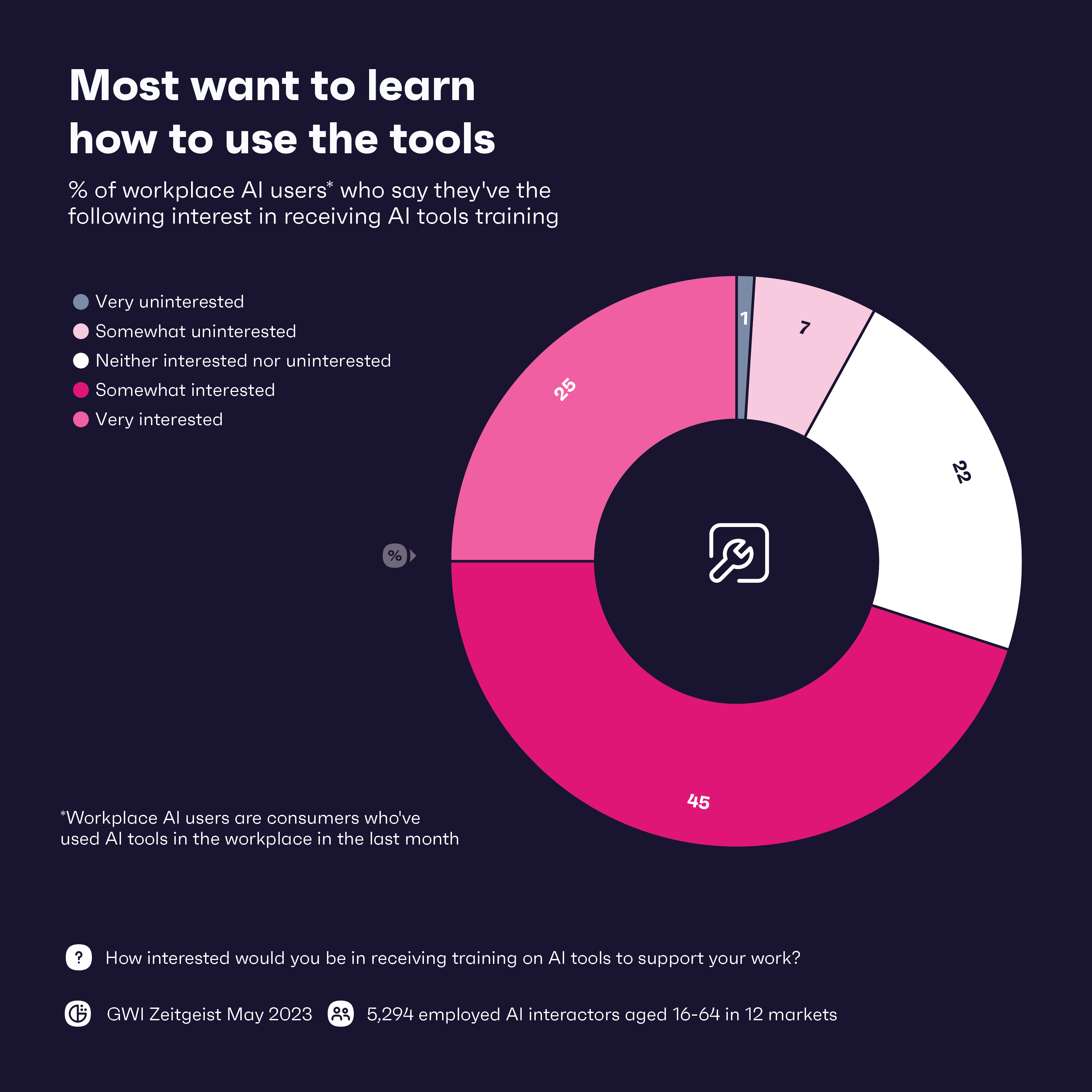

Yapay zeka çağında veri güvenliğini sağlamanın en iyi yollarından biri nedir? İlk savunma hattı, personeli yapay zeka araçları konusunda eğitmek ve çalışanların %71'i eğitimle ilgileneceklerini söylüyor. Bunu veri koruma eğitimiyle birleştirmek de eşit derecede önemlidir. Eğitim burada gerçekten çok önemlidir - çalışanları veri gizliliğinin akılda tutulmasını sağlamak için gereken bilgilerle donatmak uzun bir yol kat edecektir.

2. Sahte haber dünyasında gerçeği yansıtmak

Facebook'un 100 milyon kullanıcıya ulaşması 4,5 yıl sürdü. Karşılaştırıldığında, ChatGPT'nin bu dönüm noktasına ulaşması iki aydan biraz uzun sürdü.

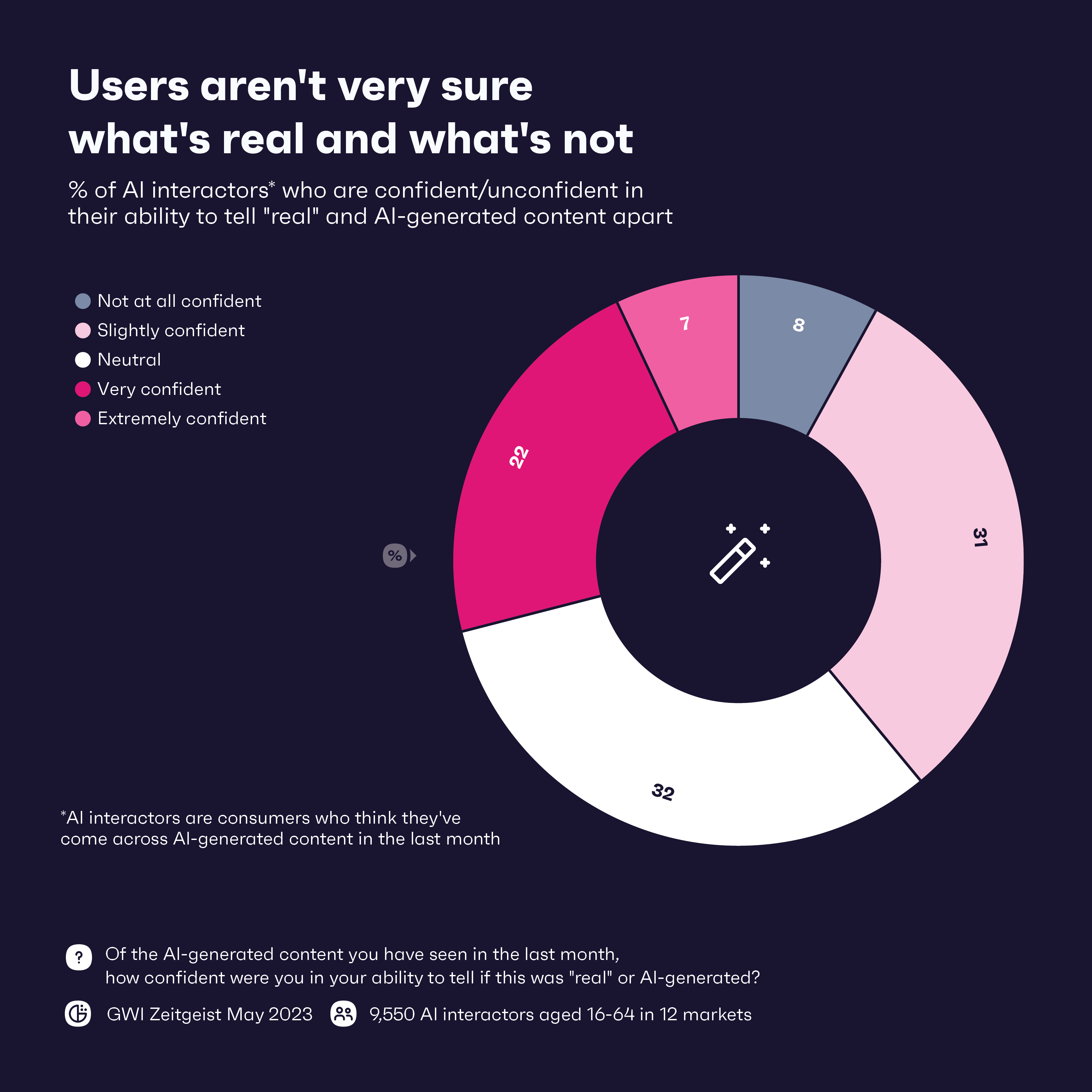

Üretken yapay zekanın yükselişi ne kadar etkileyici olsa da, deepfake olarak bilinen ses ve video biçimindeki sahte haber üretimi için bir mıknatıs haline geldi. Teknoloji zaten dünya çapında yanlış bilgi yaymak için kullanılıyor. Tüketicilerin yalnızca %29'u, yapay zeka tarafından üretilen içeriği ve "gerçek" içeriği ayırt etme becerilerine güveniyor ve bu, derin sahtekarlıklar daha sofistike hale geldikçe muhtemelen daha da kötüleşecek.

ChatGPT kullanıcılarının yaklaşık üçte ikisi, araçla gerçek bir insan gibi etkileşime girdiklerini söylüyor; bu da aracın potansiyel olarak ne kadar ikna edici olabileceğini gösteriyor.

Ancak tüketiciler bunun geldiğini gördüler; %64'ü yapay zeka araçlarının etik dışı amaçlar için kullanılabileceğinden endişe duyduklarını söylüyor. Bu endişe ve derin sahtekarlıkları tespit etme konusundaki düşük güven nedeniyle, tüketicileri bu son sahte haber dalgasından korumada ve bu tür içeriğin nasıl tespit edileceğine dair eğitim sağlamada fark yaratabilen markalardır.

Markalar, paylaşmak veya tanıtmak istedikleri herhangi bir bilgi için kaynak doğrulaması uygulayarak ve durum tespiti yaparak başlayabilir. Aynı şekilde, alabilecekleri herhangi bir haberde ortak olabilir veya kurum içi doğruluk kontrol süreçlerini kullanabilirler. Çoğu marka için, sahte haberler ve yanlış bilgilendirme yıllardır kol gezdiği için bu önlemler büyük ihtimalle çoktan uygulanmış olacak.

Ancak derin sahtekarlıklar daha akıllı hale geldikçe, markaların bunun üzerinde durması gerekecek. Bunları yenmek için markaların, yapay zeka tarafından oluşturulan içeriği tanımlayabilen ve işaretleyebilen yapay zeka tabanlı algılama araçları biçiminde bir kez daha yapay zekaya dönmesi gerekebilir. Bu araçlar, AI çağında bir zorunluluk haline gelecek, ancak kötü aktörler genellikle bir adım önde olduğu için yeterli olmayabilir. Ancak, bağlamı ve güvenilirliği doğru bir şekilde yorumlamak için tespit araçları ve insan gözetiminin bir kombinasyonu, en kötüsünü engelleyebilir.

Şeffaflık da anahtardır. Tüketicilere yapay zeka kaynaklı sahte haberlerle mücadele etmek için bir şeyler yaptığınızı bildirmek, onlarda güven puanları kazanabilir ve derin sahtekarlıklara karşı herkesin adım atmasına yardımcı olabilecek endüstri standartlarının belirlenmesine yardımcı olabilir.

3. İçsel Önyargılarla Mücadele

Kimse bir PR kabusu istemez, ancak markalar yapay zeka araçlarından aldıkları bilgileri iki kez kontrol etmezlerse bu gerçek bir olasılıktır. Unutmayın, yapay zeka araçları internetten kazınmış verilerden (insan ön yargıları, hataları ve ayrımcılıkla dolu veriler) öğrenir.

Bundan kaçınmak için markalar, yapay zeka modellerini eğitmek için çeşitli ve temsili veri kümeleri kullanıyor olmalıdır. Önyargı ve ayrımcılığı tamamen ortadan kaldırmak neredeyse imkansız olsa da, çok çeşitli veri kümeleri kullanmak bunların bir kısmını ayıklamaya yardımcı olabilir. Daha fazla tüketici, yapay zeka araçlarının nasıl geliştirildiğiyle ilgileniyor ve konuyla ilgili biraz şeffaflık, bu araçlara biraz daha güvenmelerini sağlayabilir.

Tüm markaların tarafsız veri kullanmaya özen göstermesi gerekirken, bazı sektörlerin diğerlerinden daha dikkatli olması gerekiyor. Bu sektörlerin sistemik bir ayrımcılık geçmişi olduğundan, özellikle bankacılık ve sağlık hizmetleri markalarının yapay zekayı nasıl kullandıklarının aşırı derecede farkında olmaları gerekir. Verilerimize göre, belirli topluluklara zarar veren davranışlar, tüketicilerin bir markayı boykot etmesinin en önemli nedenidir ve yapay zeka araçlarını eğitmek için kullanılan terabaytlarca veri içinde potansiyel olarak zararlı veriler bulunur.

Kullanılan veri kümelerinin ayrıntılı bir incelemesine ek olarak, markaların ayrıca tüm süreci denetlemek için insanlara, tercihen çeşitlilik, eşitlik ve kapsayıcılık (DE&I) eğitimi almış kişilere ihtiyacı vardır. GWI USA Plus veri kümemize göre DE&I, Amerikalıların %70'i için önemli ve onların değerlerini paylaşan markalardan satın alma olasılıkları daha yüksek.

4. İşyerinde otomasyon ile doğru dengeyi sağlamak

Odadaki file hitap edelim. AI, işçilerin dostu mu yoksa düşmanı mı olacak? Bildiğimiz işi değiştireceğine şüphe yok ama yapay zekanın iş yeri üzerindeki etkisinin ne kadar büyük olacağı kime sorduğunuza bağlı.

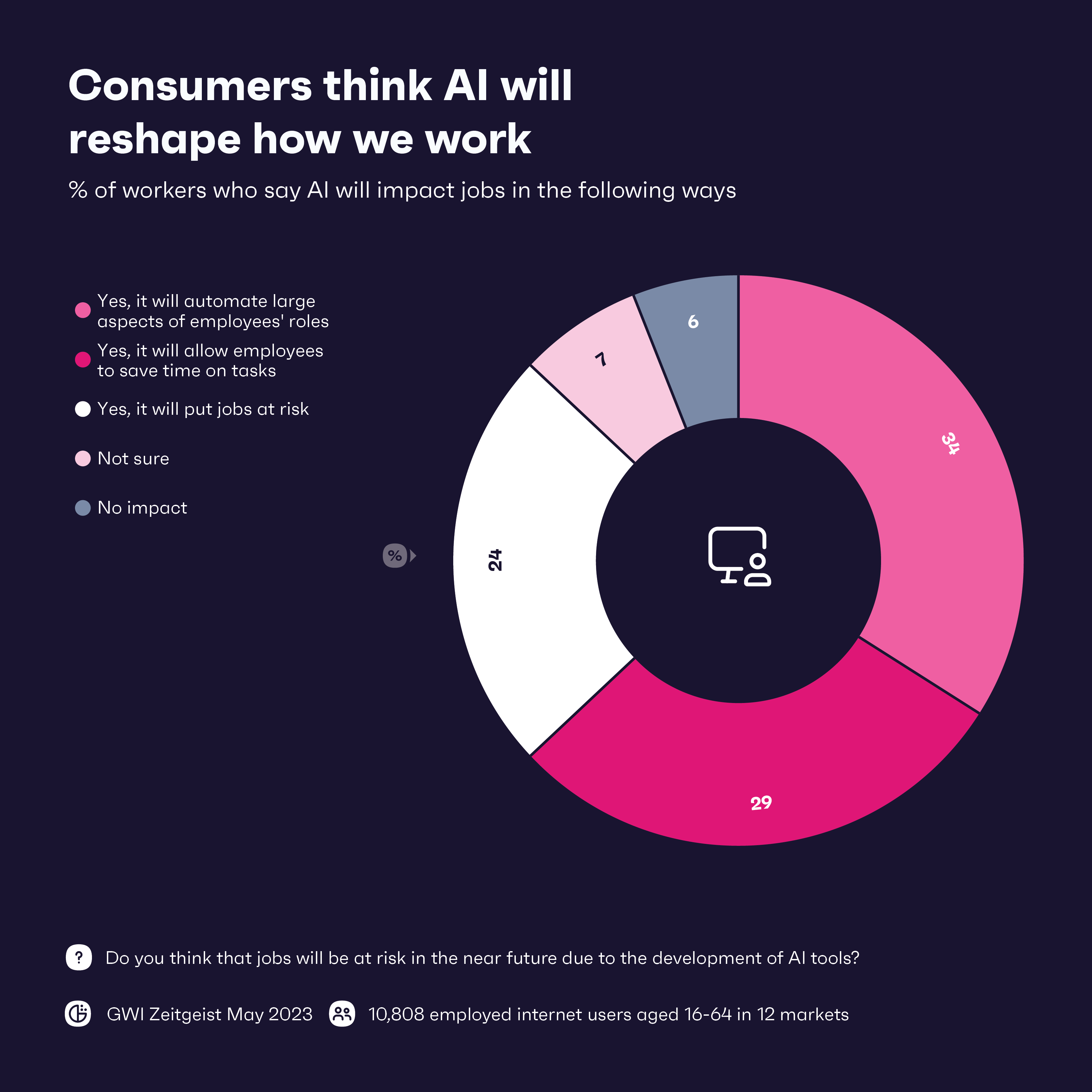

Bildiğimiz şey, çalışanların büyük bir çoğunluğunun yapay zekanın işleri üzerinde bir tür etkisi olmasını beklediği. Özellikle teknoloji ve üretim/lojistik sektörlerinde, çalışan rollerinin büyük yönlerinin otomasyonu bekleniyor. Genel olarak, 12 sektörden 8'i otomasyonun olumlu bir etkisi olacağını söyleyen işçiler yapay zeka konusunda heyecanlı görünüyor.

Öte yandan, çalışanların yaklaşık %25'i yapay zekayı işler için bir tehdit olarak görüyor ve seyahat ile sağlık ve güzellik sektörlerinde çalışanlar özellikle gergin. Üretken yapay zeka her ay katlanarak gelişiyor gibi görünüyor, bu nedenle soru şu: Yapay zeka şimdi sıradan görevleri halledebiliyorsa sırada ne var?

Yapay zeka dünya çapında yaklaşık 80 milyon işi alsa bile, çalışanlar savunmasız sektörlerde bile kendi becerilerini geliştirmek için yapay zekayı etkili bir şekilde kullanmanın yollarını bulabilir. Müşteri hizmetleri, AI ile büyük yükseltmelerden geçecek, ancak insanlar olmadan gerçekleşemez. Üretken yapay zeka çoğu sorgunun üstesinden gelebilir, ancak hassas bilgileri işlemek ve empatik bir dokunuş sağlamak için insanların orada olması gerekir. İnsanlar, özellikle seyahat ve güzellik endüstrilerinde önemli olan daha kişiselleştirilmiş çözümler ve öneriler sağlamak için yapay zeka ile de çalışabilir.

Bazı görevleri otomatikleştiren yapay zeka, çalışanları başka şekillerde katkıda bulunmaları için serbest bırakabilir. Stratejik düşünmeye ve yenilikçi çözümler bulmaya fazladan zaman ayırabilirler, bu da muhtemelen yeni ürün ve hizmetlerle sonuçlanır. Her şirket ve sektör için farklı olacak, ancak yapay zeka ile insan işçiler arasında doğru dengeyi kurabilenler, yapay zeka çağında gelişmeli.

Son bilgi istemi: Bilmeniz gerekenler

AI güçlü olabilir, ancak markaların risklerin farkında olması gerekir. Tüketici verilerini korumaları ve sahte haberlerin farkında olmaları gerekecek. Şeffaflık anahtar olacaktır. Tüketiciler yapay zekanın geleceği konusunda endişeli ve markalar onlara etik ve sorumlu bir şekilde davrandıklarını göstermek için çok yol kat edecek.

Teknoloji heyecan verici ve muhtemelen genel olarak iş yeri üzerinde olumlu bir etkisi olacak. Ancak markalar dikkatli bir şekilde ilerlemeli ve teknoloji ile insan sermayesi arasında doğru dengeyi kurmaya çalışmalıdır. Çalışanların etik, güvenlik ve doğru uygulama konularında kapsamlı eğitime ihtiyacı olacak ve bunu yapmak becerilerini yükseltecektir. Markalar, yapay zeka araçlarını doğrudan değiştirmek yerine insanlarla birlikte çalışacak şekilde entegre ederek, onları yapay zeka destekli geleceğe hazırlayacak bir denge kurabilir.