高风险,高回报:品牌如何合乎道德地使用人工智能

已发表: 2023-07-18生成式人工智能已经改变了世界,但闪光的并非都是金子。 虽然消费者对 ChatGPT 等产品的兴趣很高,但专家和消费者越来越担心人工智能对社会的危险。 对失业、数据安全、错误信息和歧视的担忧是引起恐慌的主要领域。

人工智能是美国增长最快的恐惧,比一个季度前增长了 26%。

人工智能无疑将改变我们的工作方式,但公司需要意识到随之而来的问题。 在这篇博客中,我们将探讨消费者对工作和数据安全的担忧,品牌如何减轻担忧,并保护自己和消费者免受潜在风险。

1. 保护生成式人工智能

ChatGPT 和图像创建器 DALL-E 等生成式 AI 内容正在迅速成为日常生活的一部分,超过一半的消费者至少每周都会看到 AI 生成的内容。 由于这些工具需要大量数据来学习和生成响应,因此敏感信息可能会混入其中。

生成式人工智能平台具有许多移动部件,允许用户以各种方式贡献代码,以期改进流程和性能。 缺点是,由于许多人做出了贡献,漏洞常常被忽视,并且个人信息可能会被泄露。 这正是 2023 年 5 月上旬 ChatGPT 发生的情况。

超过一半的消费者表示数据泄露会导致他们抵制某个品牌,因此需要优先考虑数据隐私。 在制定人工智能法律的同时,品牌需要自行制定透明度规则和使用指南,并向公众公布。

三分之二的消费者希望创建人工智能工具的公司对其开发方式保持透明。

这样做可以建立品牌信任,这是目前特别令人垂涎的货币。 除了质量之外,数据安全是值得信赖的品牌最重要的因素。 随着品牌忠诚度日益脆弱,品牌需要向消费者保证他们的数据是安全的。

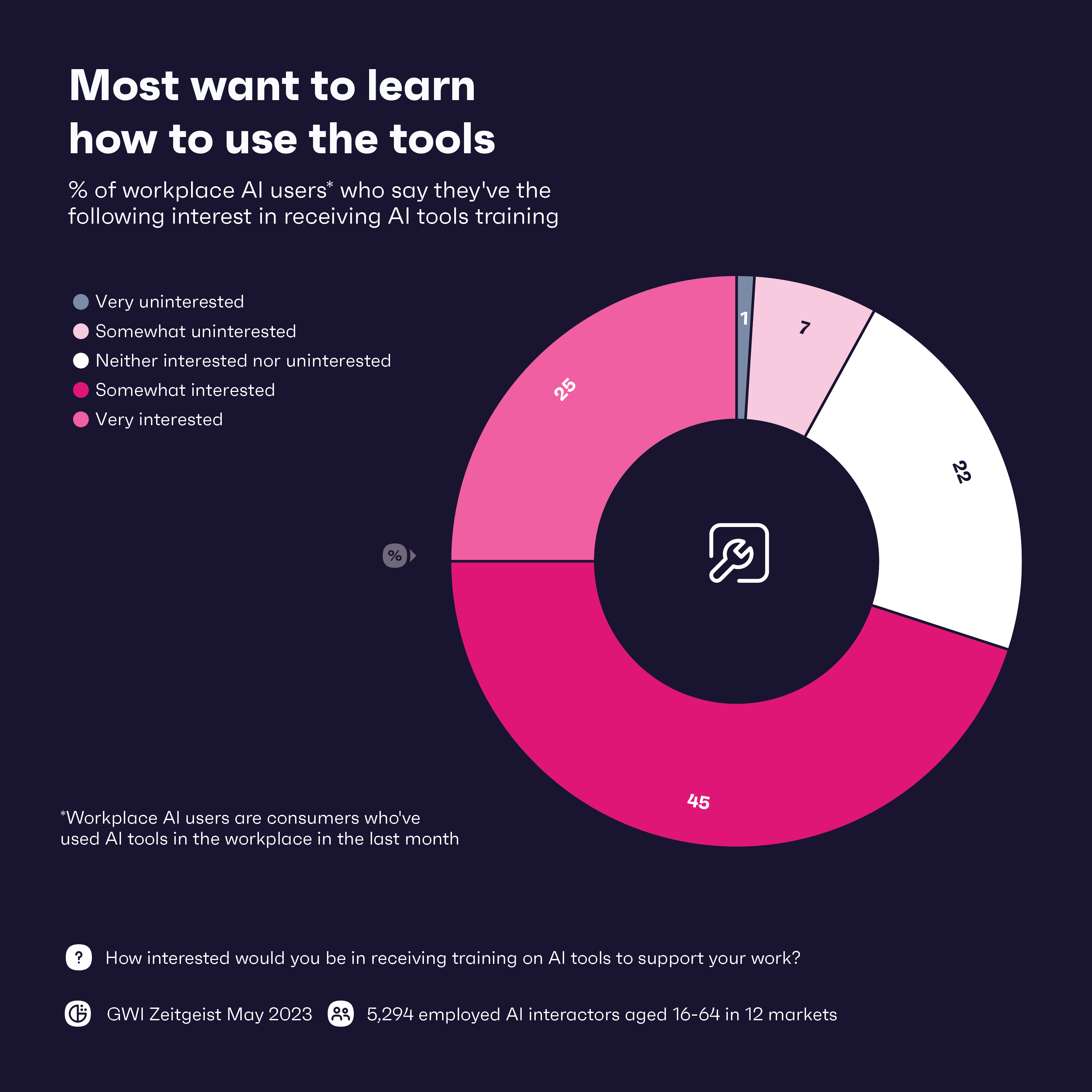

那么,在人工智能时代保护数据的最佳方法之一是什么? 第一道防线是对员工进行人工智能工具培训,71% 的员工表示他们对培训感兴趣。 将其与数据保护培训相结合同样重要。 教育在这里确实很关键——为员工提供确保数据隐私成为首要任务所需的知识将大有帮助。

2. 在假新闻世界中保持真实

Facebook用了4.5年的时间才达到1亿用户。 相比之下,ChatGPT 仅用了两个多月的时间就达到了这一里程碑。

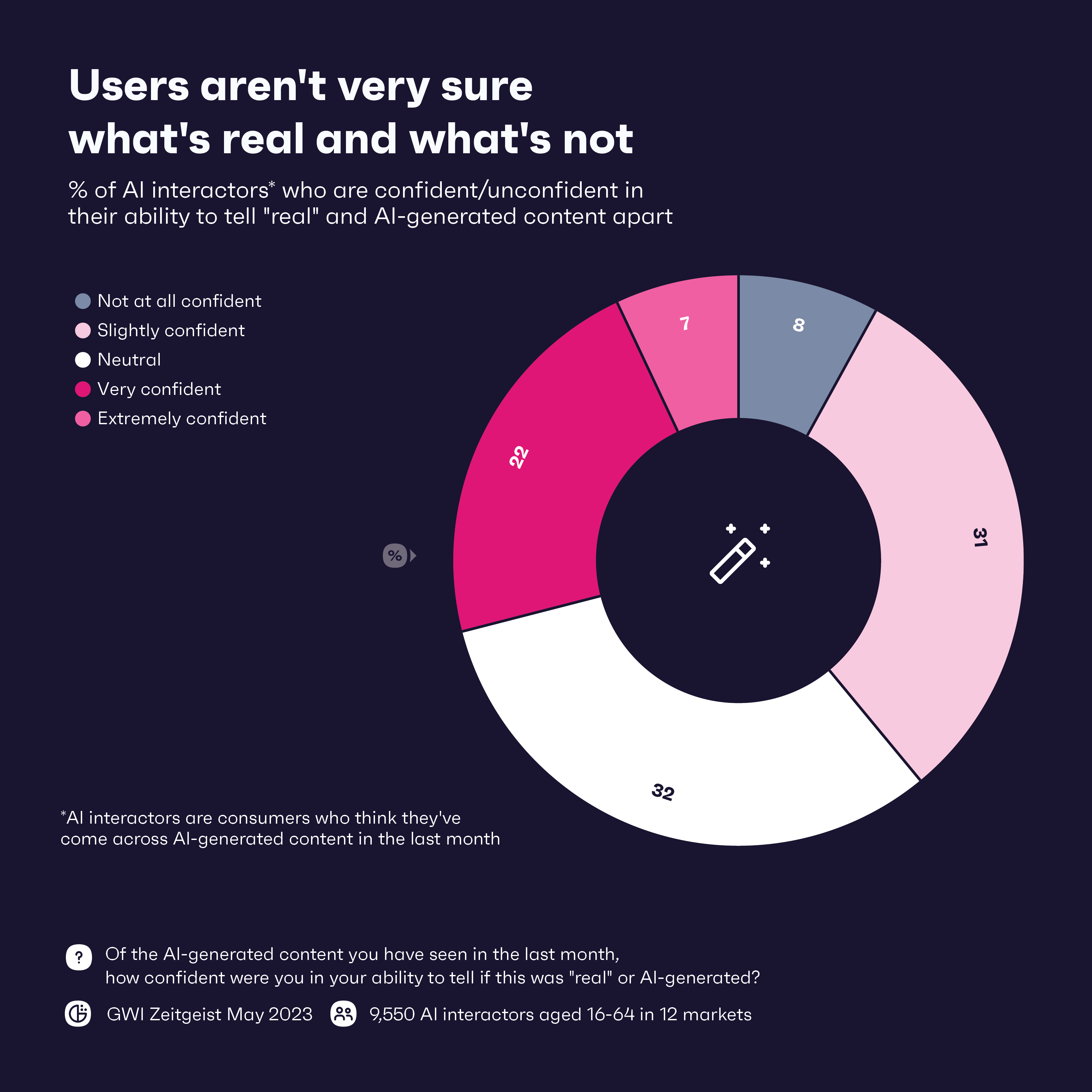

尽管生成式人工智能的崛起令人印象深刻,但它一直吸引着以音频和视频形式创作假新闻(即“深度伪造”)。 该技术已被用来在全球范围内传播错误信息。 只有 29% 的消费者对自己区分人工智能生成的内容和“真实”内容的能力充满信心,随着深度造假变得更加复杂,这种情况可能会变得更糟。

近三分之二的 ChatGPT 用户表示,他们与该工具的交互就像与真人一样,这表明该工具的说服力有多大。

但消费者已经预见到了这一点; 64% 的人表示他们担心人工智能工具可能被用于不道德的目的。 考虑到这种担忧,以及对检测深度造假的信心不足,品牌可以在保护消费者免受最新一波假新闻影响并提供如何识别此类内容的教育方面发挥重要作用。

品牌可以首先实施来源验证并对他们想要分享或推广的任何信息进行尽职调查。 同样,他们可以对可能收到的任何新闻报道进行合作或使用内部事实核查流程。 对于大多数品牌来说,这些措施可能已经到位,因为多年来假新闻和错误信息一直猖獗。

但随着深度假货变得越来越聪明,品牌将需要保持领先地位。 为了击败它们,品牌可能需要再次求助于人工智能,以基于人工智能的检测工具的形式,这些工具可以识别和标记人工智能生成的内容。 这些工具将成为人工智能时代的必需品,但这可能还不够,因为不良行为者通常会先行一步。 但是,结合检测工具和人工监督来正确解释上下文和可信度可能会阻止最坏的情况发生。

透明度也很关键。 让消费者知道您正在采取措施应对人工智能生成的假新闻,可以赢得他们的信任,并有助于制定行业标准,帮助每个人与深度伪造保持同步。

3. 消除固有偏见

没有人想要一场公关噩梦,但如果品牌不对从人工智能工具获得的信息进行双重检查,这种可能性就确实存在。 请记住,人工智能工具从互联网上抓取的数据中学习——这些数据充满了人类偏见、错误和歧视。

为了避免这种情况,品牌应该使用多样化且具有代表性的数据集来训练人工智能模型。 虽然完全消除偏见和歧视几乎是不可能的,但使用广泛的数据集可以帮助消除其中的一些偏见和歧视。 更多的消费者关心人工智能工具的开发方式,而该主题的一些透明度可能会让他们更加信任这些工具。

虽然所有品牌都应该关心使用公正的数据,但某些行业必须比其他行业更加小心。 银行和医疗保健品牌尤其需要高度了解他们如何使用人工智能,因为这些行业有系统性歧视的历史。 根据我们的数据,对特定社区造成伤害的行为是消费者抵制某个品牌的首要原因,而用于训练人工智能工具的数 TB 数据中蕴藏着潜在的有害数据。

除了对所使用的数据集进行详细审查之外,品牌还需要人员(最好是接受过多元化、公平和包容性 (DE&I) 培训的人员)来监督整个过程。 根据我们的 GWI USA Plus 数据集,DE&I 对 70% 的美国人很重要,他们更有可能从与其价值观相同的品牌购买产品。

4. 在工作场所与自动化取得适当的平衡

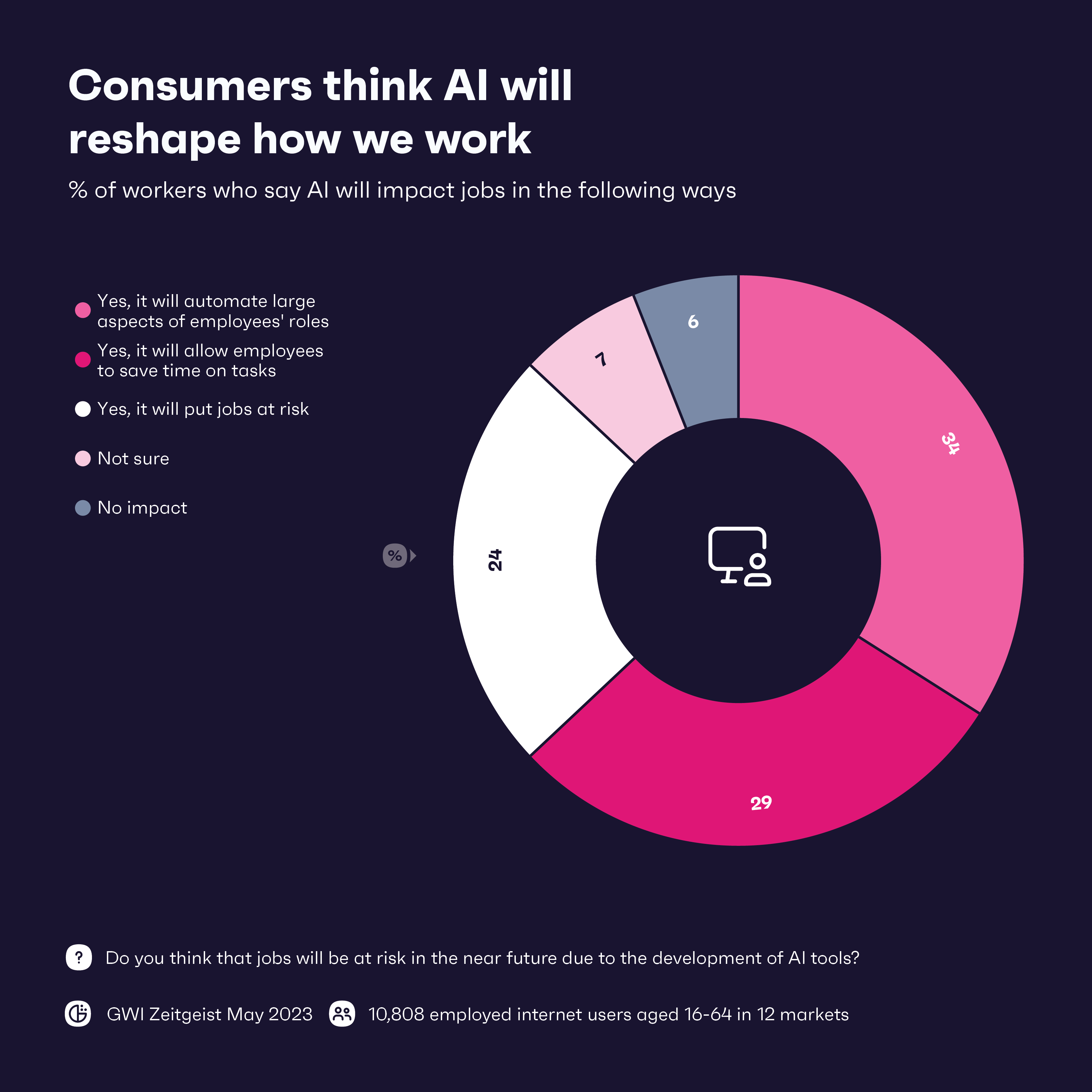

让我们谈谈房间里的大象。 人工智能对于工人来说是朋友还是敌人? 毫无疑问,正如我们所知,它将改变工作,但人工智能对工作场所的影响有多大取决于你问的是谁。

我们所知道的是,绝大多数工人希望人工智能对他们的工作产生某种影响。 预计员工角色的大部分方面将实现自动化,特别是在科技和制造/物流行业。 总体而言,工人们似乎对人工智能感到兴奋,12 个行业中有 8 个行业表示自动化将产生积极影响。

另一方面,近 25% 的员工认为人工智能对就业构成威胁,而那些在旅游、健康和美容行业工作的人尤其紧张。 生成式人工智能似乎每个月都在呈指数级增长,所以问题是:如果人工智能现在可以处理平凡的任务,那么接下来会发生什么?

即使人工智能确实在全球范围内夺去了约 8000 万个工作岗位,工人也可以找到有效使用人工智能的方法来提高自己的技能,即使是在脆弱的行业。 人工智能的客户服务将经历重大升级,但如果没有人类,这一切就不可能发生。 生成式人工智能可以处理大多数查询,但人类需要在那里处理敏感信息并提供同理心。 人类还可以与人工智能合作,提供更加个性化的解决方案和建议,这在旅游和美容行业尤其重要。

人工智能自动化某些任务可以让员工腾出时间以其他方式做出贡献。 他们可以投入额外的时间进行战略思考并提出创新解决方案,可能会产生新产品和服务。 每个公司和行业都会有所不同,但那些能够在人工智能和人类工人之间取得适当平衡的人应该在人工智能时代蓬勃发展。

最后提示:您需要了解什么

人工智能可能很强大,但品牌需要意识到其中的风险。 他们需要保护消费者数据并警惕假新闻。 透明度将是关键。 消费者对人工智能的未来感到紧张,品牌向他们表明他们的行为符合道德和负责任,这将大有帮助。

这项技术令人兴奋,并且可能会对整个工作场所产生积极影响。 但品牌应该谨慎行事,并努力在技术和人力资本之间取得适当的平衡。 员工需要接受有关道德、安全和正确应用的广泛培训,这样做可以提高他们的技能。 通过整合人工智能工具与人们一起工作,而不是彻底取代它们,品牌可以取得平衡,为人工智能增强的未来做好准备。