BERT:谷歌多年來最大的更新

已發表: 2022-12-01谷歌的 BERT 於 2019 年底上線,影響了近 10% 的搜索。 可以說是 2019 年最大的算法更新之一,這裡是 SEO 和網站所有者應該了解的有關 Google 高級自然語言處理模型的所有信息。

什麼是谷歌的 BERT?

BERT 是一種深度學習算法,是 Bidirectional Encoder Representations from Transformers 的簡稱。 該算法有助於為複雜的搜索查詢提供更相關的結果。

BERT 算法更新對谷歌搜索有何影響?

谷歌是這樣說的:

“這些改進旨在提高語言理解力,特別是對於更自然的語言/會話查詢,因為 BERT 能夠幫助搜索更好地理解搜索中單詞的細微差別和上下文,並更好地將這些查詢與有用的結果相匹配。

特別是對於更長、更多會話的查詢,或者搜索中的“for”和“to”等介詞對含義有很大影響,Search 將能夠理解查詢中單詞的上下文。 你可以以一種對你來說很自然的方式進行搜索。”

事實上,根據谷歌的說法,BERT 更新將影響美國十分之一的英語搜索,即搜索查詢的 10%。 這是 Google 在過去 5 年中最重要的更新,至少根據他們的說法:

我們正在對我們理解查詢的方式進行重大改進,這是過去五年中最大的飛躍,也是搜索歷史上最大的飛躍之一。

BERT 的引入在新算法部署的第一周引起了較大的排名波動。 Webmaster World 的 SEO 一直在評論自本周初以來的波動,並指出自 RankBrain 以來 SEO 世界的最大排名波動。

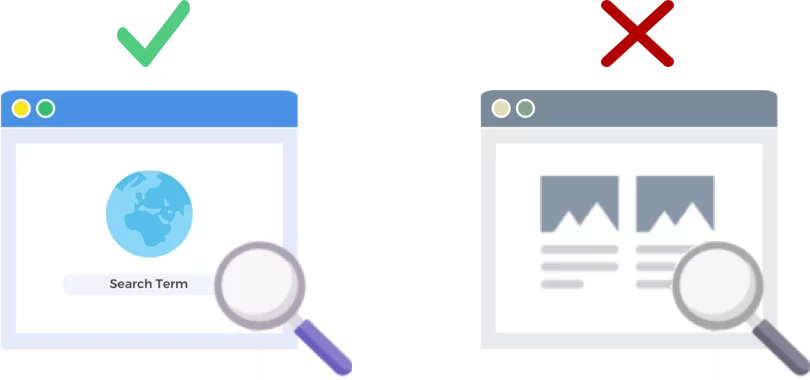

BERT 分析搜索查詢而不是網頁

2019 年 10 月 24 日發布的 BERT 算法改進了搜索引擎巨頭分析和理解搜索查詢(而非網頁)的方式。

BERT 是如何工作的?

BERT 使用雙向(即 BERT 中的 B)上下文模型提高了 Google 對搜索查詢的理解。 去年這個時候,谷歌宣布 BERT 作為一種用於自然語言處理 (NLP) 預訓練的新技術時,他們實際上談到了 BERT 的機制。

什麼是預訓練? 預訓練只是在你實際給它工作之前教機器如何做任務。 傳統的預訓練數據集加載了幾千到幾十萬個人工標記的例子。

預訓練已經存在了一段時間,但 BERT 的特別之處在於它既是上下文相關的(每個詞的含義根據其周圍的詞發生變化)又是雙向的——一個詞的含義是根據它之前和之前的詞來理解的在它之後。

根據谷歌的博客:

在“ I accessed the bank account ”這句話中,單向上下文模型將表示基於“ I accessed the ”而非“ account ”的“ bank ”。 然而,BERT 表示“銀行”同時使用其上一個和下一個上下文——“我訪問了……賬戶”——從深度神經網絡的最底部開始,使其深度雙向。

Google BERT 更新建立在機器學習和實體識別的最新進展之上。 基本上,BERT 有助於在 Google 處理搜索之前識別詞的所有詞性和上下文。

BERT 對搜索結果意味著什麼?

據谷歌稱,這意味著用戶將開始看到更相關的結果,即更符合用戶搜索意圖的結果。 此算法改進將涵蓋常規結果和豐富網頁摘要結果。

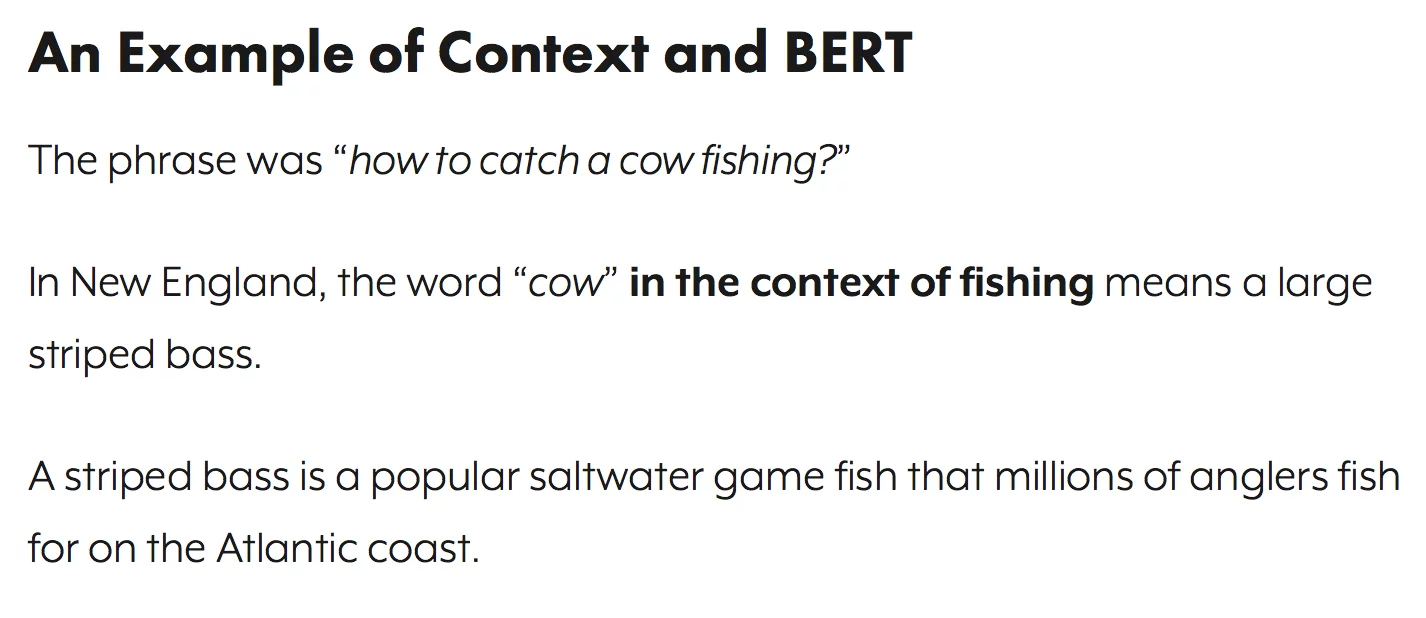

谷歌在他們宣布 BERT 的博客文章中提供了一些有用的例子。

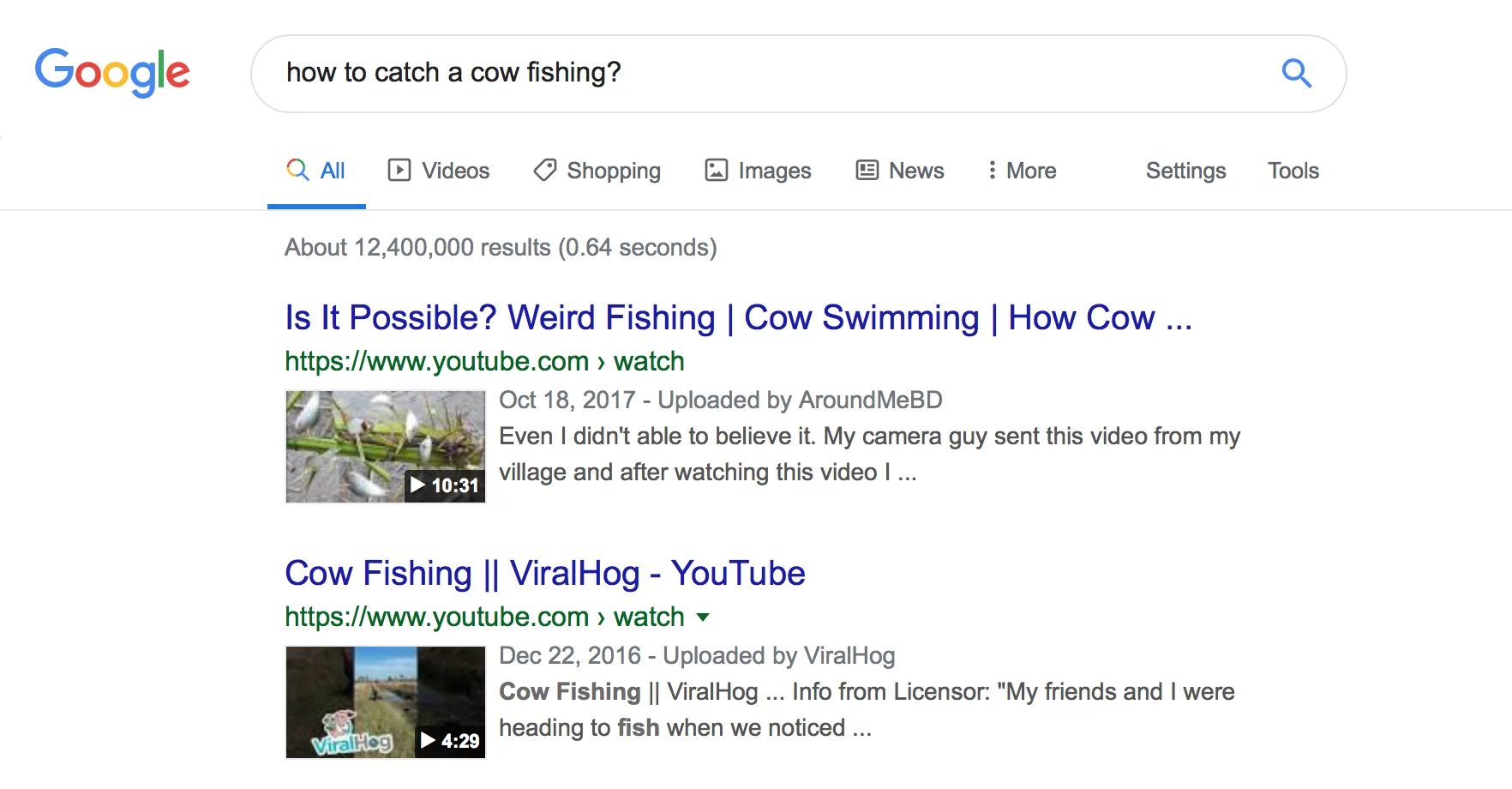

美學家的例子

首先,我們有一位用戶試圖了解美學家是否在工作中花費大量時間站立。

您可以在下面看到,在 BERT 之前,Google 閱讀了“美容師工作時工作量大嗎”的查詢,並生成了比較美容師工作環境類型的結果。

在 BERT 之後,Google 顯示了一篇關於成為美學家的身體要求的文章,這與搜索者最初試圖顯示的信息更加一致。

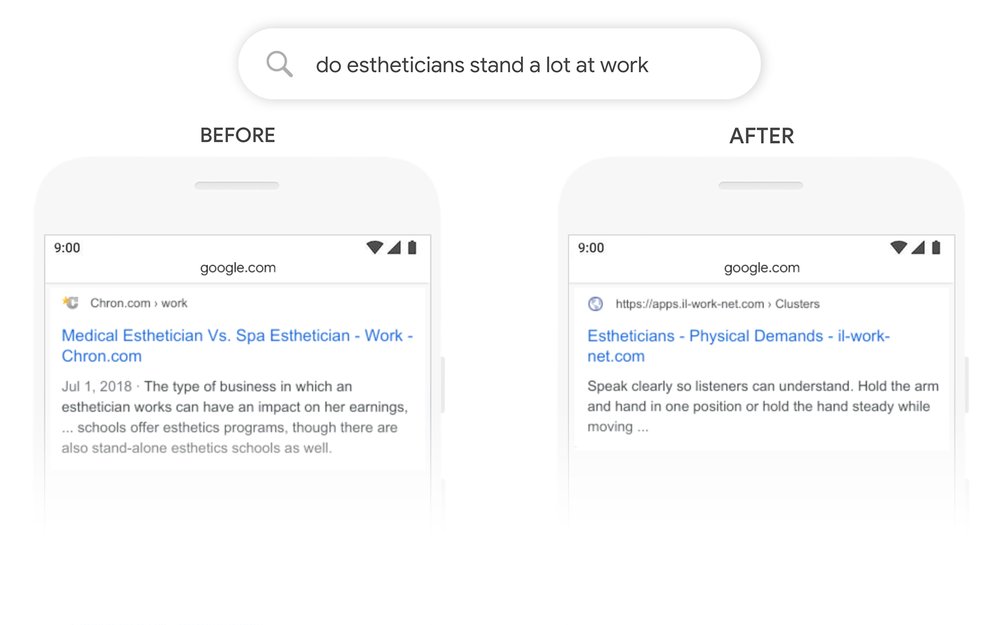

數學練習書示例

在此示例中,用戶正在尋找成人數學練習書,但顯示了兒童數學練習書。

在 BERT 之後,谷歌正確識別了查詢的上下文,更好地解釋了“成人”搜索的第二部分。

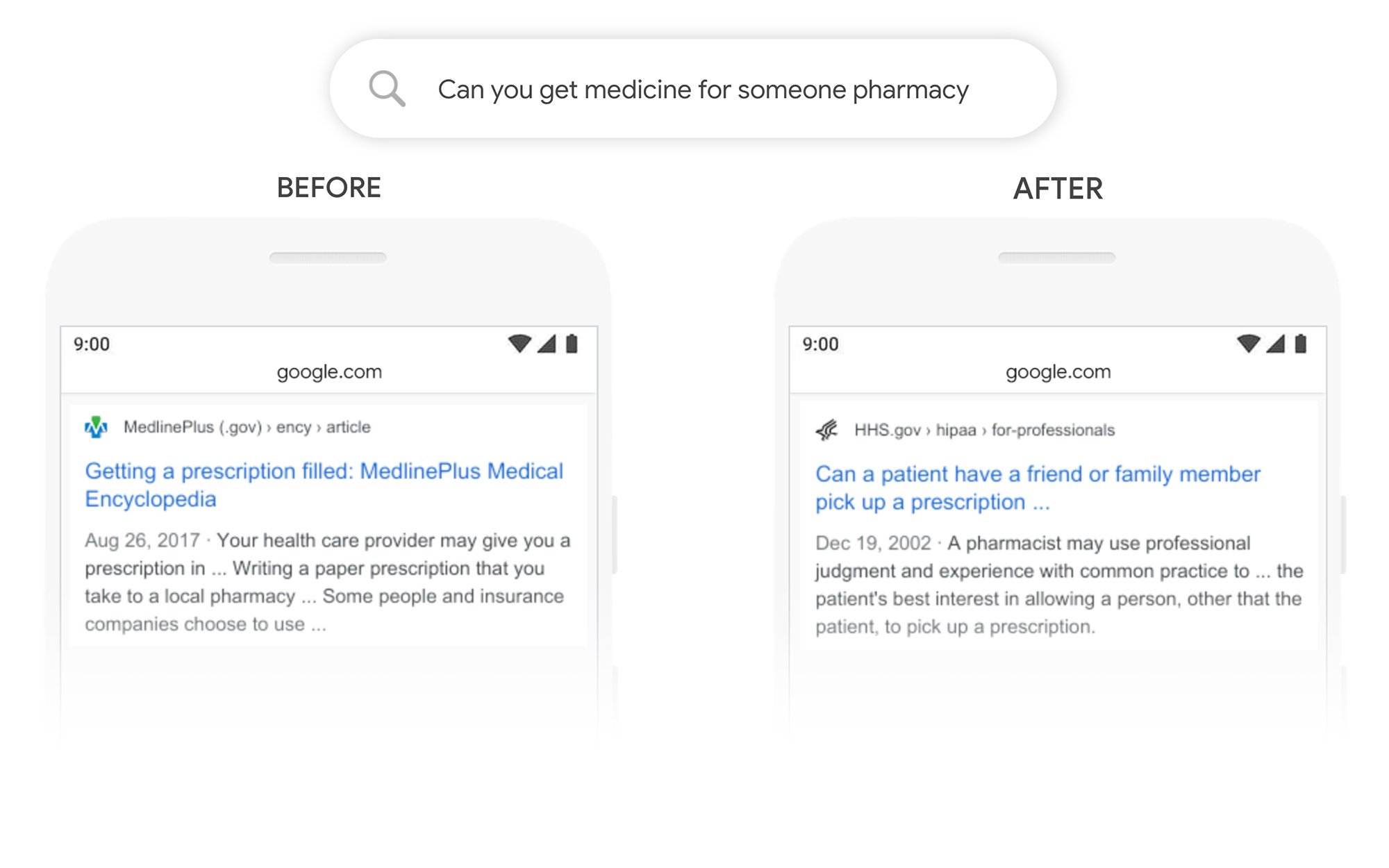

你能為別人拿藥嗎?

在這個例子中,查詢“你能為某人藥房買藥嗎”返回一個關於如何填寫處方的結果,而不是如何為第 3 方填寫處方。 在 BERT 之後,谷歌更好地理解了用戶的目標,並展示了一個關於患者是否可以讓朋友或家人為他們取藥的文章。

在 BERT 之後我可以做些什麼來提高排名?

對於任何失去排名的關鍵字,您應該查看修改後的搜索結果頁面,以更好地了解 Google 如何查看您的目標字詞的搜索意圖。 然後相應地修改您的內容以更好地滿足用戶的目標。

如果您在 BERT 下失去排名,則更有可能是與您的頁面與用戶搜索意圖的匹配程度(幫助用戶達到他們的目標)相關的問題,而不是內容質量問題。

鑑於 BERT 可能會隨著時間的推移進一步支持語音搜索工作,我們還建議網站撰寫清晰簡潔的文案。 不要使用填充語言,不要含糊不清,開門見山。

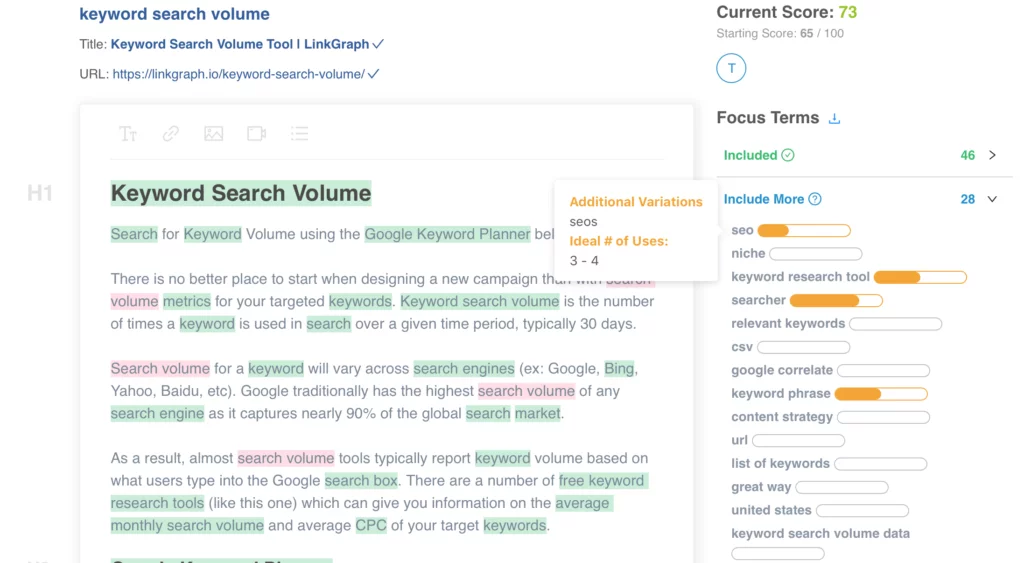

需要幫助優化您的內容? 查看 LinkGraph 的頁面內容優化器,通過 [email protected] 聯繫我們的團隊成員,或安排會議以立即進行設置。

我在哪裡可以了解更多?

本月早些時候,道恩·安德森 (Dawn Anderson) 在 Pubcon 上就“Google BERT 和 Family and the Natural Language Understanding Leaderboard Race”做了精彩的演講,您可以看看她的演講。

感謝您參加我的#Pubcon。 這是我的牌組 <3 <3 https://t.co/aGYDI9pfdY

- 道恩安德森 (@dawnieando) 2019 年 10 月 10 日

Jeff Dean 最近還在 Google 的 AI(包括 BERT)上發表了主題演講,您可以觀看。